Ученый-исследователь OpenAI Чэнь Боюань опубликовал статью о Чжиху, которая начинается очень прямо:«Привет всем, я Чэнь Боюань, научный сотрудник команды GPT Image. Модель генерации изображений GPT, выпущенная на прошлой неделе, была моим основным обучением!»Он также упомянул, что на этот раз наконец-то исправлена китайская рендеринг модели. Если у китайских пользователей есть какие-либо отзывы, вы можете ответить им напрямую.

После выпуска ChatGPT Images 2.0 первая реакция многих людей была такой:Китайские возможности этой модели немного необоснованны.

Имиджевые модели в прошлом были несколько «непонятными». Они могут рисовать пейзажи и фигуры, но если в дело вступают китайские иероглифы, они легко могут превратиться в неразборчивую мешанину призрачных символов. Но GPT-image-2 — это другое. Он может не только писать правильные слова, но также верстать, сегментировать и генерировать китайскую информационную графику с логической структурой.

Старый метод «просмотреть текст, чтобы определить, был ли он сгенерирован ИИ» больше не работает в этом поколении.

Чэнь Боюань — один из тех, кто действительно стоял у стойки регистрации во время обучения и демонстрации способностей GPT Image 2. На пресс-конференции он и Ultraman продемонстрировали возможности рендеринга текста. После релиза он объяснил множество интересных моментов, стоящих за фотографиями Чжиху на официальном сайте: во время двойного слепого теста LMArena в качестве кодового имени GPT Image 2 использовалось «клейкая лента»; многие фотографии в официальном блоге сайта сделаны им с моделями; Китайские комиксы, гравюры рисовых зерен, многоязычные тексты, визуальные доказательства и автоматически генерируемые QR-коды. Эти картинки, похожие на рекламные материалы, на самом деле созданы для того, чтобы снова и снова проверять способности.

Он использовал очень интересное объяснение этой «изоленты»:

«Что касается того, почему это называется клейкой лентой… конечно, это потому, что с помощью клейкой ленты можно приклеить бананы на стену!»

01

Он задает более медленный вопрос

Чэнь Боюань не из тех исследователей, которых можно запомнить с первого взгляда. Здесь нет частых публичных выступлений и сознательного управления личным самовыражением. Он ведет блоги и публикует беззаботный контент, но это больше похоже на рекорды, чем на усиление влияния.

Напротив, его присутствие больше связано с самой моделью.

Сейчас он является исследователем в OpenAI и занимается обучением моделей изображений. До этого он защитил докторскую диссертацию по электротехнике и информатике в Массачусетском технологическом институте со специализацией по философии. Он также участвовал в исследовании мультимодальных моделей в Google DeepMind.

Этот опыт достаточно привлекателен, но, что более важно, его долгосрочные заботы.

От DeepMind до OpenAI направление исследований Чэнь Боюаня почти не изменилось. Когда большинство людей все еще обсуждают, можно ли написать модель лучше и нарисовать ее более подробно, их беспокоит более базовый уровень: что «понимает» модель.

В частности, это можно рассматривать как три вопроса: Как модель понимает изображение? Каково соотношение образа и языка? Когда модель сталкивается с реальным миром, генерирует ли она результаты или моделирует мир?

Эти вопросы звучат абстрактно, но они в значительной степени определяют границы сегодняшнего поколения моделей.

На своей личной странице он очень прямо пишет о направлении своих исследований:Модели мира, воплощенный интеллект и обучение с подкреплением.

Так называемую модель мира можно понимать как одно: позволить ИИ формировать суждения о мире внутри себя.

Он должен не только знать, что происходит перед вами, но и уметь предсказывать, что произойдет дальше.

Это немного отличается от сегодняшней распространенной LLM (большой языковой модели). LLM больше похож на язык обработки, а модель мира ближе к структуре: она должна понимать пространство, время, причину и следствие, а также результаты поведения.

Если использовать очень простой пример, то если ИИ действительно «понимает» мир, он должен знать, что пластиковый стаканчик подпрыгнет, если его уронить на землю, а стеклянный разобьется.

Воплощенный интеллект и обучение с подкреплением можно понимать как расширение этой проблемы: если модель действительно понимает мир, она должна не просто отвечать на вопросы, но также иметь возможность действовать и постоянно пересматривать свои суждения во время действия.

Работа, которой он занимается, часто представляет собой не оптимизацию одной задачи, а попытку соединить воедино генеративные модели, визуальное понимание и системы принятия решений.

Одна из его наиболее представительных работ — исследование под названием «Диффузионное воздействие».

Это исследование пытается решить очень простой вопрос: создается ли модель шаг за шагом или она создается сразу?

LLM — первый вариант, который хорош в гибкой генерации, но склонен к ошибкам в длинном контенте; диффузионная модель ближе ко второй, которая более устойчива, но лишена структуры.

Подход Чэнь Боюаня состоит в том, чтобы поместить эти два метода в одну и ту же модель, чтобы модель можно было создавать постепенно и ограничивать целое.

Если Diffusion Forces – это объединение во временном измерении, то SpatialVLM, еще одна работа, в которой он участвовал, – это дополнение возможностей в пространственном измерении.

Эта работа решает давнюю проблему: хотя модель может смотреть на картинки и говорить, она не совсем понимает пространственные отношения. Он не знает расстояния, размера или относительного положения объектов.

Чтобы решить эту проблему, его команда построила трехмерную систему пространственного мышления, чтобы модель могла не только «видеть», но и «рассуждать».

Подобные идеи появлялись и в других работах, таких как метод, основанный на истории, который использует историческую информацию для управления поколением, или исследования по единому моделированию видения, действия и языка. Эти усилия могут показаться разрозненными, но все они указывают в одном направлении: заставить модель не просто выводить результаты, но и формировать стабильное внутреннее представление.

Помимо серьезного исследовательского направления, Чэнь Боюань также иногда проявляет очень яркий личный интерес.

Например, на этот раз он опубликовал статью о Чжиху и, например, специально сообщил на своей личной домашней странице, что его интересует изготовление боба, и даже его имя на Чжиху — «Менеджер магазина чая с молоком MIT».

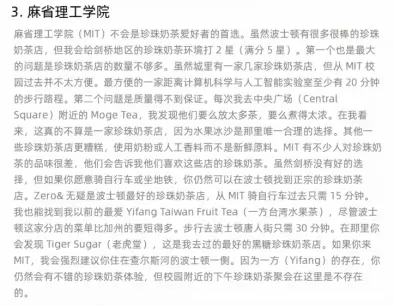

Он также вел блог, в котором составлял рейтинг лучших школ информатики в Соединенных Штатах. Критерием была не сила научных исследований, а чай с пузырьковым молоком.

Он поставил Беркли на первое место, потому что кампус «почти окружен магазинами высококачественного чая с молоком», а Массачусетский технологический институт получил низкую оценку, потому что «поблизости слишком мало магазинов чая с молоком, а качество нестабильно».

Этот тип выражения очень расслаблен, но видно, что его исследовательские привычки таковы: разбирать сложные проблемы, находить сопоставимые измерения, а затем выносить суждения.

Сама его работа заключается в чем-то похожем, но объект заменяется моделью.

02

Он избегал более легкого направления

Если вы посмотрите только на путь развития моделей изображений, логика прошлого на самом деле очень ясна: большие данные, более высокое разрешение и более стабильный процесс генерации. Большинство улучшений сосредоточено на «рисовании более похожего».

Но по мере того, как модель начинает обрабатывать более сложный контент, этот путь также достигает узкого места: когда изображение содержит не только визуальные элементы, но и текст, структуру и даже логические связи, вопрос уже не просто в том, нравится или непохоже, а в том, как при этом устанавливается эта информация.

Проблема смещается от качества производства к структурной последовательности.

Не все исследователи будут решать задачи такого типа. Он не соответствует напрямую определенному показателю оценки, и его сложно перевести в эффект продукта в краткосрочной перспективе. Напротив, зачастую легче увидеть улучшения при работе над разрешением, стилем и деталями.

Путь Чэнь Боюаня заключался в том, чтобы избежать этих «более простых» направлений: с самого начала его исследований на академической стадии его внимание было сосредоточено не на одномодальных способностях, а на том, как различные способности связаны друг с другом.

Долгое время визуальные модели, языковые модели и системы принятия решений развивались независимо. Их можно подключать через интерфейсы, но внутри они часто разделены. Поэтому, хотя модель может «призвать к использованию возможностей», сложно продемонстрировать последовательное понимание.

Задача Чэнь Боюаня — попытаться изменить эту ситуацию.

Многие возможности модели на этот раз были продемонстрированы на стыке «изображений, текста, мемов, реальных объектов и культурного контекста».

Чэнь Боюань сказал, что многие фотографии в официальном блоге были сделаны им. Весь блог создан с использованием изображений, без обычного текста. Иными словами, многие примеры, которые пользователи видят на официальном сайте, — это не просто рекламные материалы, а часть самих возможностей модели.

Например, тот китайский комикс о пасхальных яйцах.

Он хотел сделать очень забавный мультфильм, поэтому использовал «стебель банана» и «поймай стебель». Чтобы продемонстрировать свои способности к письму, он специально попросил модель добавить к изображению текст на нескольких языках, а также создал очень маленькие китайские иероглифы в правом нижнем углу плаката родного города, чтобы проверить, насколько мелкие детали может обрабатывать модель.

Что еще более важно, эта картинка не склеена — по его словам, вся картинка, включая «картинка в картинке» и «картинка в картинке в картинке», генерируется сразу. Он беспокоился, что люди подумают, что это склеенная фотография, поэтому намеренно добавил примечание внизу картинки.

Это просто иллюстрирует сложность GPT-изображения 2. Если бы модель изображения прошлого могла написать несколько больших символов без ошибок, это считалось бы очень хорошим. Но GPT Image 2 приходится иметь дело с целым набором уровней: ему нужно знать, что это фотография из комикса, в комиксе есть картинки, а в картинках есть картинки; необходимо разместить текст на разных языках на разных уровнях; также необходимо установить связь между этими словами и картинкой, а не беспорядочно разбрасывать их по картинке.

Другой пример — гравировка рисовых зерен.

Чэнь Боюань рассказал, что поначалу ему показалось, что обычная визуализация текста недостаточно ошеломляющая, поэтому он сделал изображение в разрешении 4K по подсказкам своих товарищей по команде: на снимке была изображена куча рисовых зерен, на одном из которых были выгравированы слова.

Это проверяет способность модели управлять текстом в чрезвычайно малых масштабах.

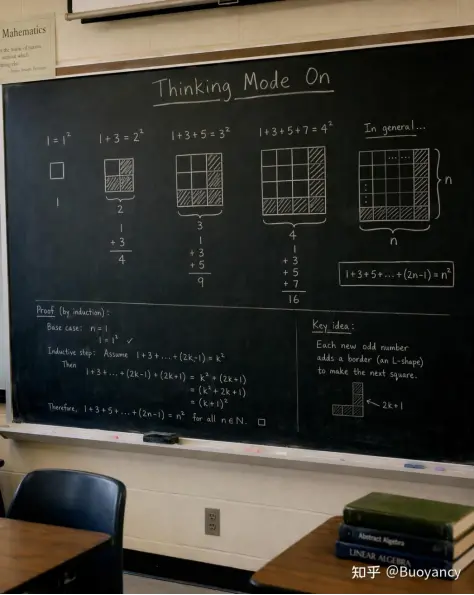

И эта доска наглядного доказательства.

Чэнь Боюань сказал: «Это кажется слишком простым, если вы попросите его решить обычные математические уравнения и тому подобное. Нано-банан, кажется, способен сделать это в режиме мышления + рендеринг текста. Поэтому я подумал о визуальном доказательстве, которое мне очень нравится, чтобы по-настоящему протестировать изображение GPT 2. Уникальный визуальный эффект рассуждения. но графическое решение можно осуществить только с помощью визуальной модели».

Это также одно из наиболее примечательных изменений в выпуске GPT Image 2: оно может начать превращать абстрактные отношения в структуру изображения, а затем выражать эту структуру визуально.

Поэтому вместо того, чтобы говорить, что GPT Image 2 «генерирует изображения», лучше сказать, что оно генерирует визуальное выражение со структурой.

Комиксы, плакаты, визуальные доказательства... ни одна из этих вещей по своей природе не является просто картинкой. Они также содержат текст, типографику, иерархию, объектные отношения, цели задач и эстетические суждения.

Прошлые модели изображений, как правило, здесь не работают, потому что они рассматривают изображения как результаты пикселей. Это поколение более сильных имиджевых моделей должно относиться к изображениям как к структурированному выражению.

03

он не одинок

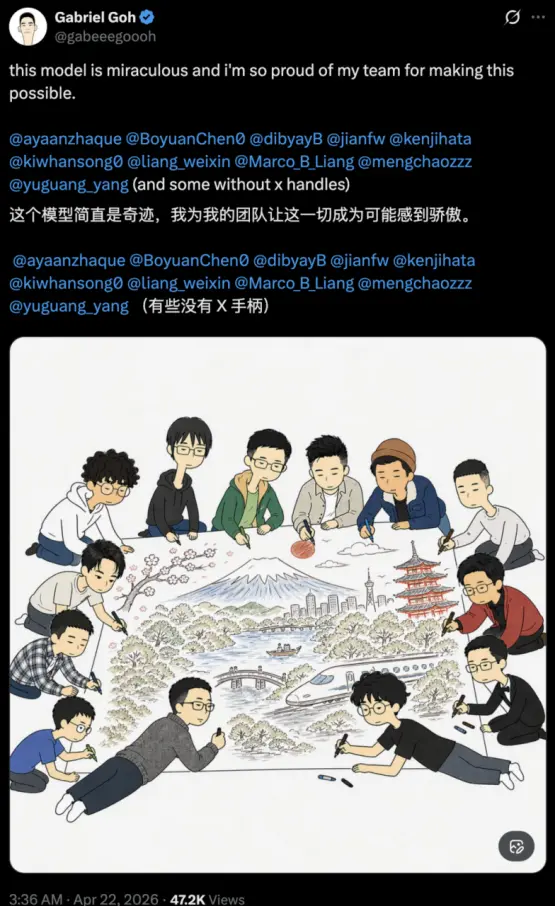

В OpenAI не так уж много людей занимаются обучением моделей. После публикации GPT-image-2 руководитель исследования Габриэль Го публично поблагодарил членов своей команды в социальных сетях.

Список небольшой, всего десяток человек.

Это больше похоже на небольшую команду, чем на большую инженерную систему.

Члены команды разбросаны в разных направлениях: кто-то занимается видением, кто-то механизмами генерации, кто-то занимается структурой системы, но в конечном итоге они указывают на одно и то же: дать модели набор возможностей, которые могут одновременно обрабатывать изображения, язык и структуру.

Иллюстрация в твите тоже в какой-то степени похожа на метафору: собирается группа людей, каждый отвечает за свою часть, и в итоге они образуют одну и ту же картину.

Структура модели, границы возможностей и даже «каким должен быть образ» — все это создается в такой команде по крупицам.

Стоит отметить, что среди основной команды, состоящей из более чем десятка человек, мы можем увидеть немалое количество китайских имен.

Помимо Чэнь Боюаня, в него также входят Цзяньфэн Ван, который занимается моделированием визуального языка, Вэйсинь Лян, который занимается оценкой моделей и проблемами данных, Югуан Ян, который долгое время занимается генерацией изображений, и многие исследователи, занимающиеся генерацией изображений и обучением систем.

Чэнь Боюань не назвал этот инцидент личной победой. В конце статьи Чжиху он особо поблагодарил всю команду. Он сказал, что каждый сделал много-много вещей. В конце предзапуска, помимо исправления некоторых мелочей, он работал с коллегами из отдела маркетинга и коллегами по искусству над подготовкой пресс-конференции и веб-сайта.

Другими словами, GPT Image 2 — это совместное завершение исследований, продуктов, эстетики и коммуникации. Команда модели должна создать возможности, команда художников должна знать, какие изображения могут отображать эти возможности, а команда маркетинга должна преобразовать эти возможности в изображения, которые обычные пользователи смогут понять, захотят протестировать и будут готовы распространять.

Вот почему многие примеры в этом выпуске особенные. В конечном итоге они не просто создают красивую картинку, а активно создают проблемы: несколько языков, очень мелкий текст, картинка в картинке, реальные объекты, визуальное доказательство, плакаты, созданные поиском, и встраивание QR-кода.

Каждое изображение сообщает пользователю: то, что, по вашему мнению, модель изображения не могла сделать раньше, вы можете попробовать еще раз сейчас.

С этой точки зрения положение Чэнь Боюаня совершенно особенное.

Он занимается как обучением моделей, так и издательским повествованием; он не только участвовал в создании модели, но и лично разработал множество изображений, чтобы внешний мир мог понять возможности модели.

Изображение GPT 2, конечно, не является работой одного только Чэнь Боюань, но, судя по общедоступной информации, Чэнь Боюань действительно является одним из имен, наиболее заслуживающих внимания китайского сообщества в этом выпуске модели изображения.

С одной стороны, выпущенная на этот раз модель генерации графов GPT была его основным обучением; с другой стороны, именно ему принадлежит прорыв, который легче всего воспринимается китайскими пользователями: китайский рендеринг.

Когда ИИ, наконец, смог записывать китайский язык в сложные изображения, на передний план вышел исследователь, который долгое время изучал модели мира, пространственное понимание и генеративную последовательность.

«Надеюсь, на этот раз мы всех благополучно поймали», — сказал он.