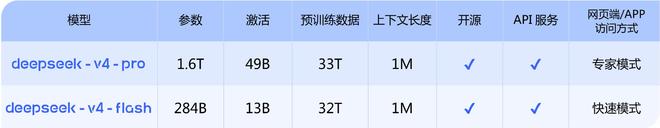

24 апреля DeepSeek объявила, что предварительная версия новой серии моделей DeepSeek-V4 была официально запущена и одновременно с ней открыт исходный код. DeepSeek-V4 имеет сверхдлинный контекст, состоящий из миллиона слов, и лидирует в отечественных областях и областях с открытым исходным кодом с точки зрения возможностей агента, мировых знаний и производительности рассуждений. Модель разделена на две версии: deepseek-v4-flash и deepseek-v4-pro по размеру.

С этого момента войдите на официальный сайт или в официальное приложение, чтобы поговорить с новейшей версией DeepSeek-V4 и изучить новые возможности сверхдлинной контекстной памяти объемом 1 МБ. Служба API обновляется синхронно, и ее можно вызвать, изменив model_name на deepseek-v4-pro или deepseek-v4-flash.

По сравнению с моделью предыдущего поколения возможности агента DeepSeek-V4-Pro значительно расширены. В оценке агентного кодирования V4-Pro достиг лучшего уровня среди текущих моделей с открытым исходным кодом, а также показал хорошие результаты в других оценках, связанных с агентами. В настоящее время DeepSeek-V4 стала моделью агентного кодирования, используемой внутренними сотрудниками компании. Согласно отзывам об оценке, опыт использования лучше, чем у Sonnet 4.5, а качество доставки близко к режиму без мышления Opus 4.6, но все же существует определенный разрыв с режимом мышления Opus 4.6.

По имеющимся данным, DeepSeek-V4 создал новый механизм внимания, который сжимает размерность токена и объединяет его с разреженным вниманием DSA (DeepSeek Sparse Attention) для достижения лучших в мире возможностей длинного контекста и значительного снижения требований к вычислениям и видеопамяти по сравнению с традиционными методами. Отныне контекст в 1М (миллион) будет стандартным для всех официальных сервисов DeepSeek.

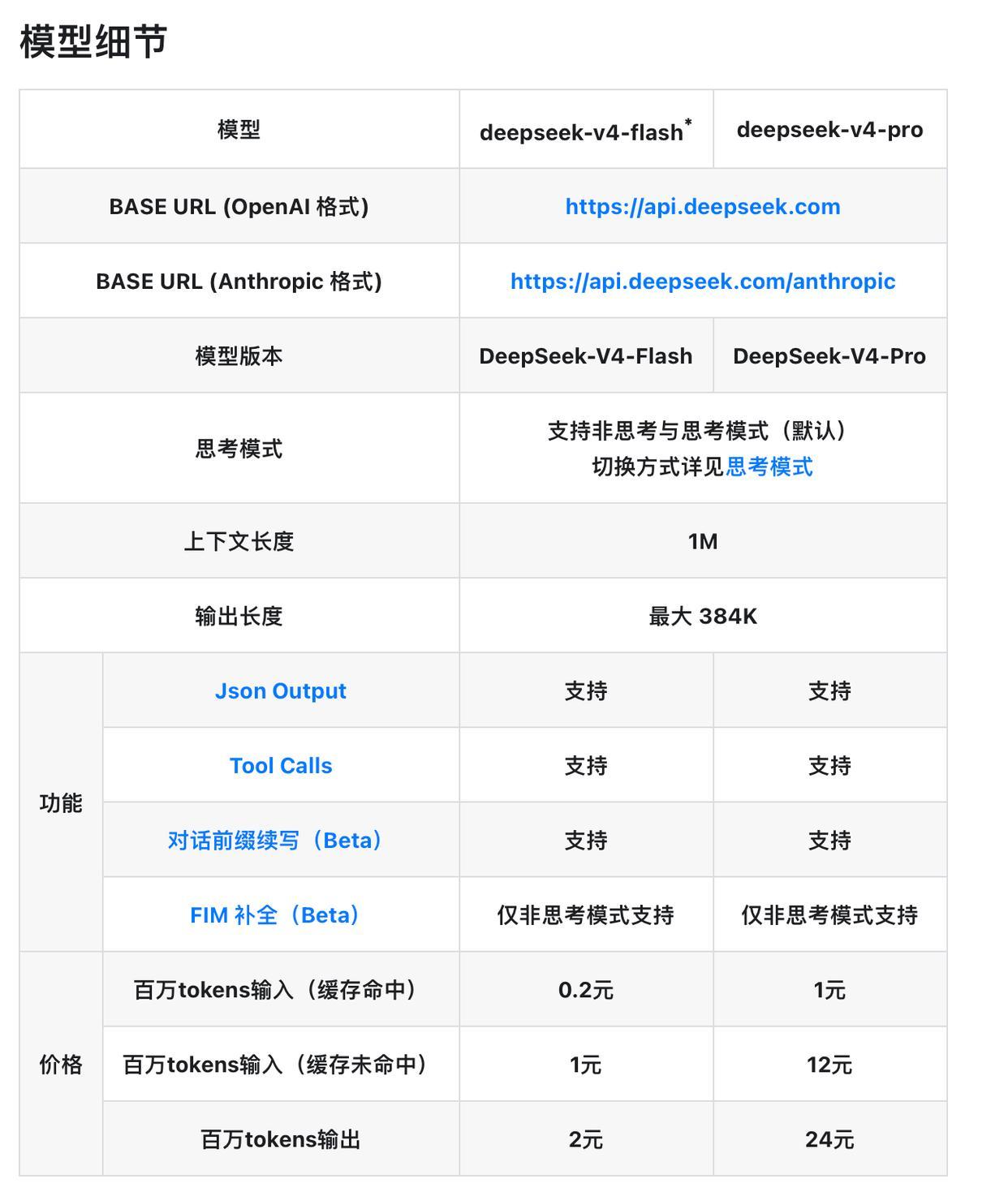

Максимальная длина контекста V4-Pro и V4-Flash составляет 1 МБ. Оба поддерживают режим без мышления и режим мышления . Режим мышления поддерживает параметр Reasoning_effort для установки интенсивности мышления (высокая/максимальная). Для сложных сценариев агента рекомендуется использовать режим мышления и устанавливать максимальную интенсивность.

В настоящее время DeepSeek API запущен одновременно на V4-Pro и V4-Flash, поддерживая интерфейс OpenAI ChatCompletions и интерфейс Anthropic. При доступе к новой модели base_url остается неизменным, а параметр модели необходимо изменить на deepseek-v4-pro или deepseek-v4-flash.