24 апреля предварительная версия DeepSeek-V4 была официально выпущена и одновременно с открытым исходным кодом. утверждает, что достиг ведущего уровня в отечественной области и в области открытого исходного кода по трем измерениям: возможности агента, мировые знания и эффективность рассуждений. DeepSeek-V4 разделен на две версии: Pro и Flash, обе из которых поддерживают сверхдлинный контекст на миллион (1 млн) токенов. Обе версии значительно снижают требования к вычислительной и графической памяти, сокращая количество операций вывода на тег на 73 % и уменьшая использование кэш-памяти KV на 90 %.

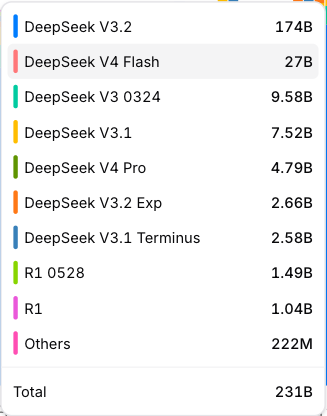

24 апреля данные OpenRouter, крупнейшей в мире платформы агрегирования интерфейсов прикладного программирования моделей искусственного интеллекта, показали, что количество вызовов V4-Flash достигло 27 миллиардов токенов, а V4-Pro составило 4,79 миллиарда токенов, но они не появлялся в рейтингах.

После выпуска DeepSeek-V4 основные оценочные платформы провели тестирование возможностей и ранжирование.

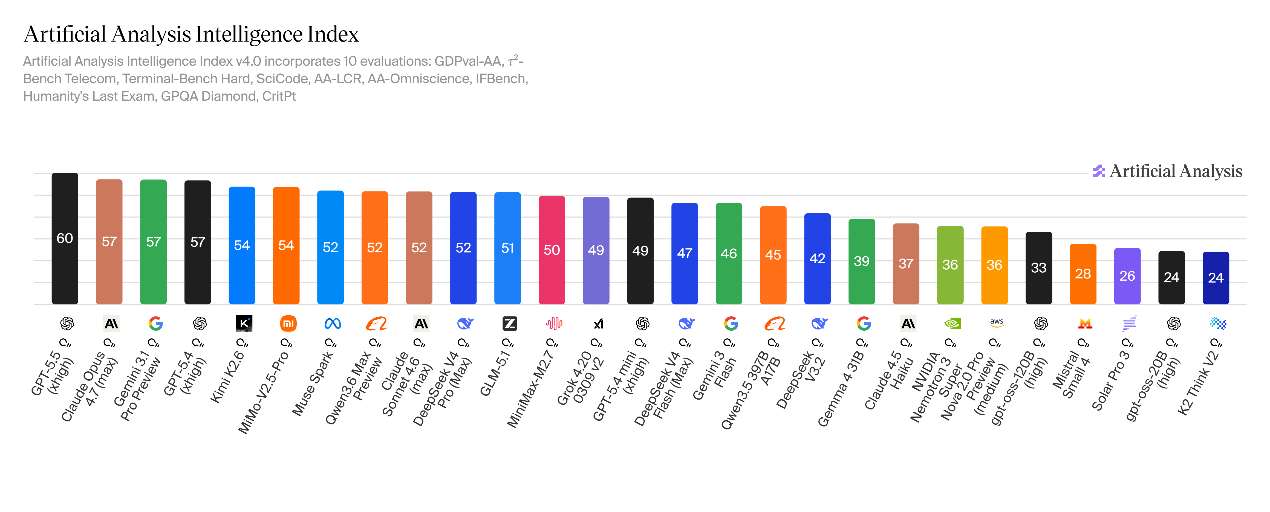

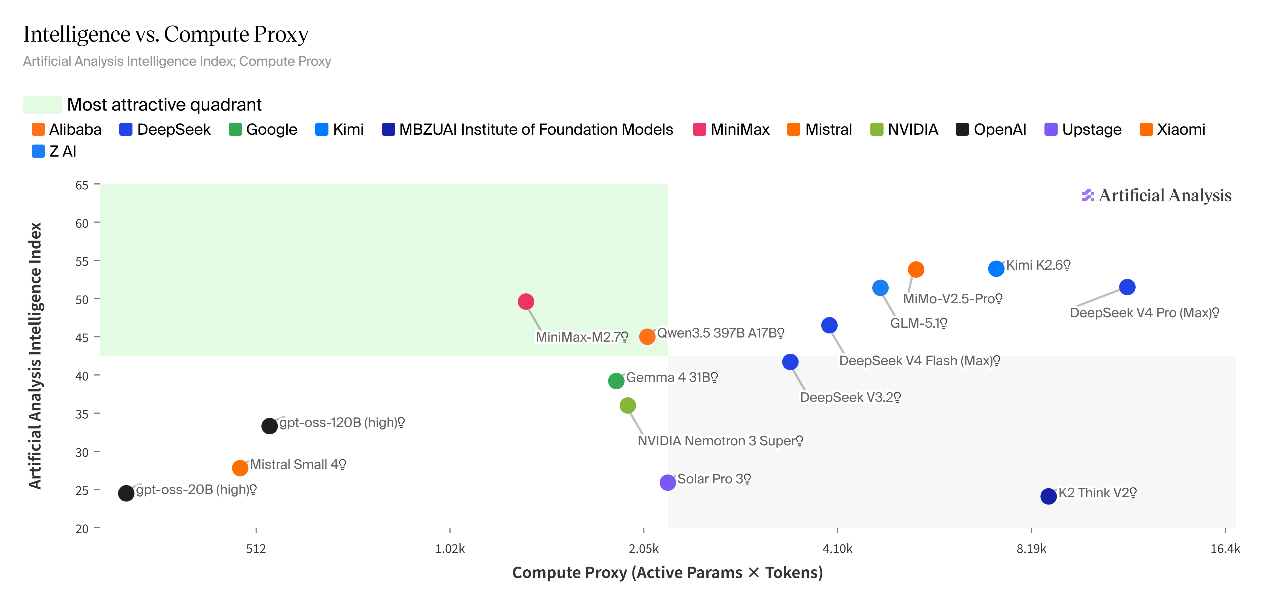

Artificial Analysis провел специальную оценку способностей рассуждения DeepSeek-V4. Результаты показывают, что V4-Pro набрал 52 балла в индексе искусственного интеллекта анализа, достиг скачка на 10 пунктов по сравнению с 42 баллами версии V3.2, а стал второй по величине в мире моделью вывода с открытым исходным кодом после Kimi K2.6.

V4-Flash набрал 47 баллов. Его производительность уступает V4-Pro, но он значительно превосходит DeepSeek-V3.2. Его всеобъемлющий уровень интеллекта сравнивается с Claude Sonnet 4.6 (полная версия), которая находится между лучшей моделью с закрытым исходным кодом и основной моделью среднего класса.

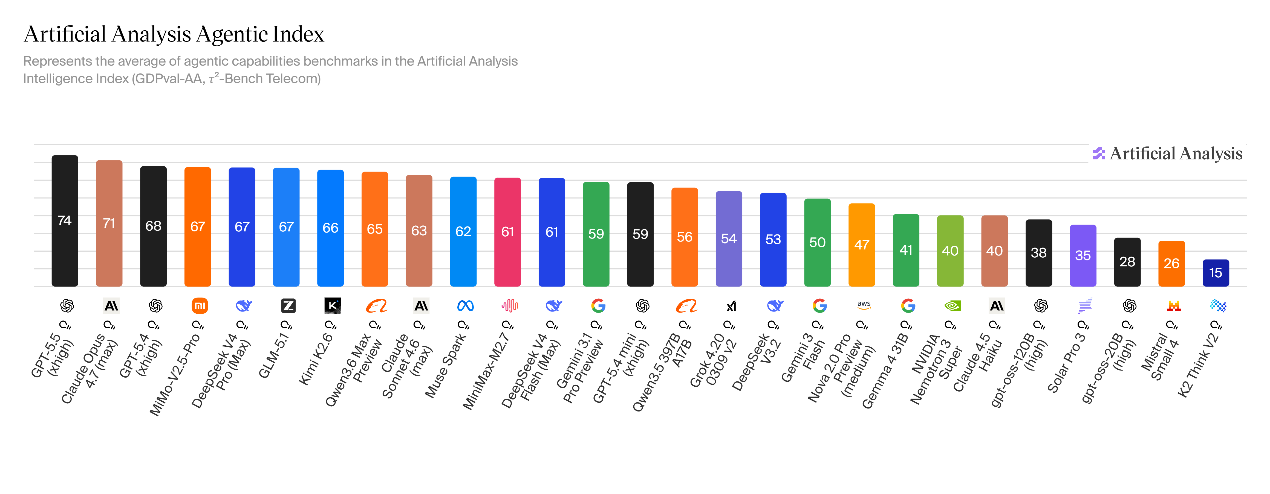

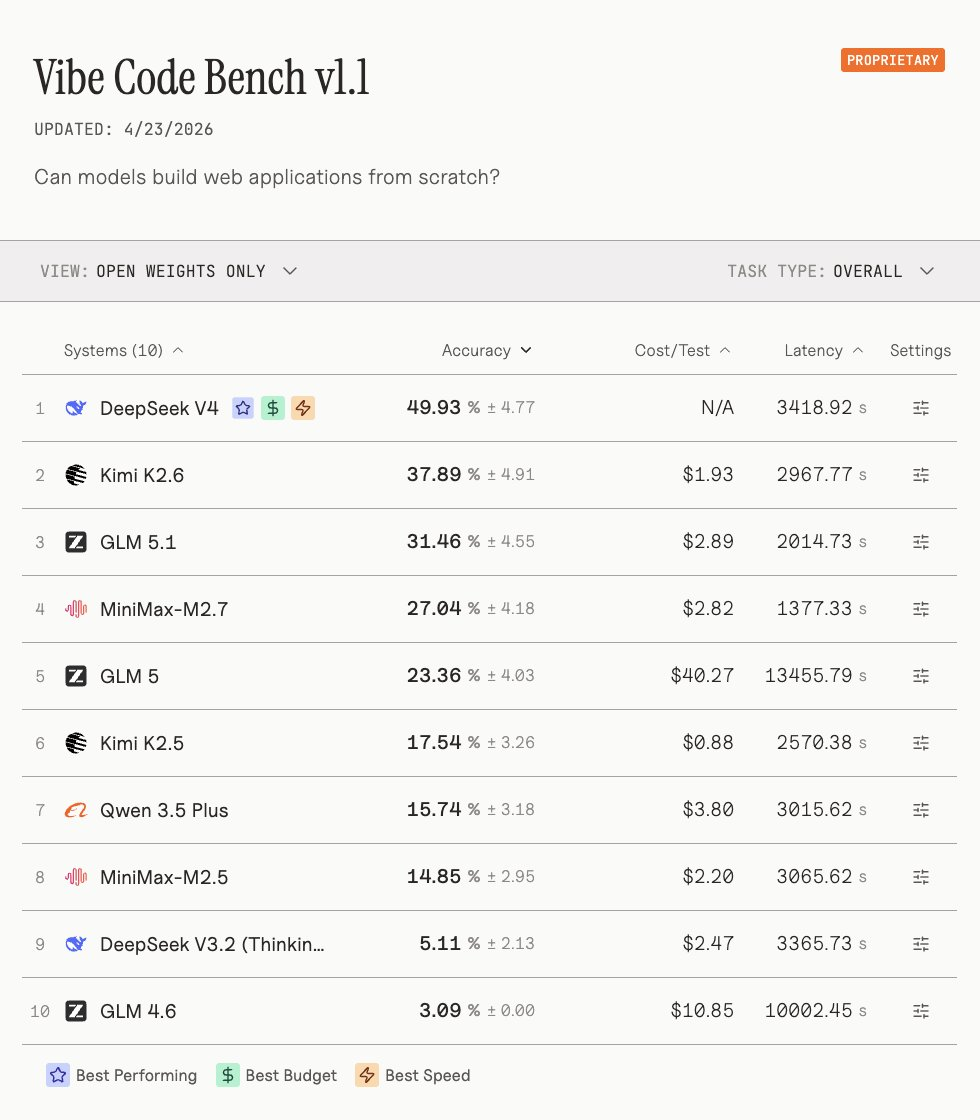

С точки зрения производительности задач агента, V4-Pro имеет самую высокую производительность среди всех весовых моделей с открытым исходным кодом в реальных задачах агента. набрал 1554 балла, опередив Kimi K2.6 (1484), GLM-5.1 (1535), GLM-5 (1402) и MiniMax-M2.7 (1514).

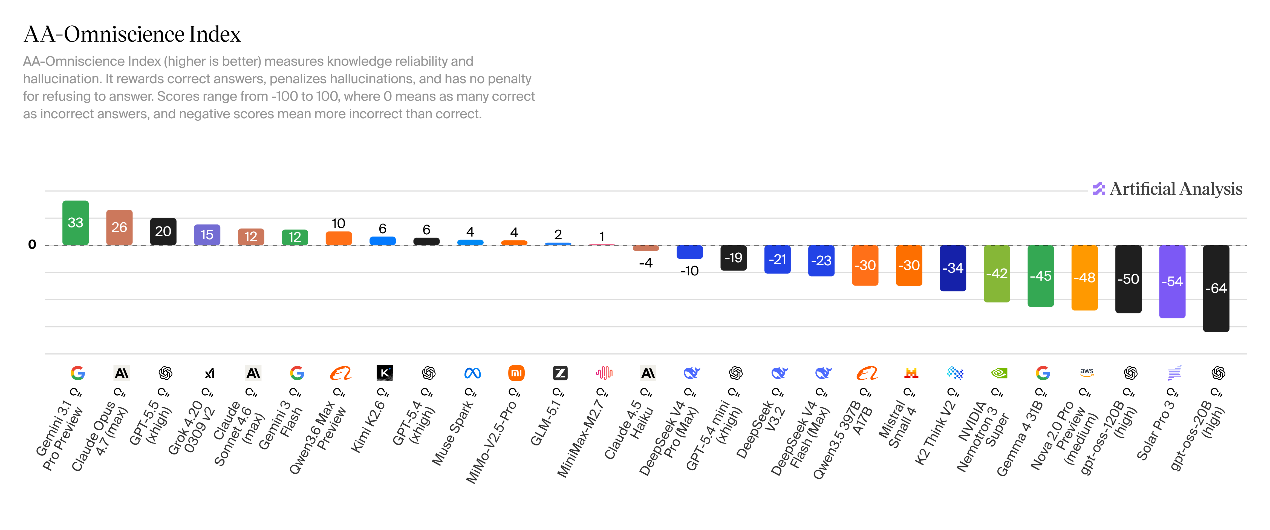

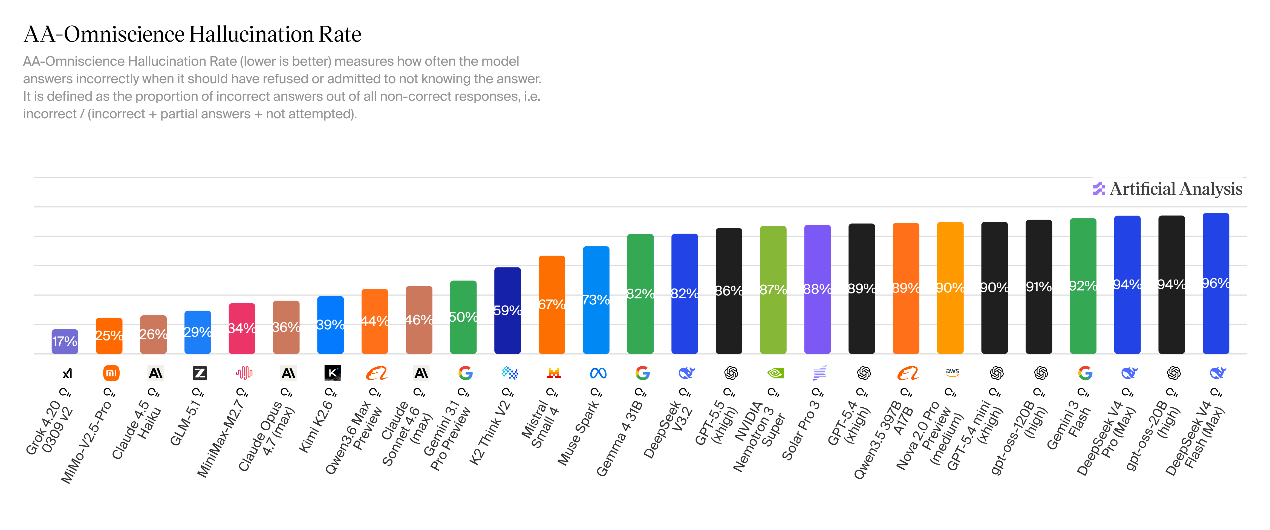

Запас знаний DeepSeek-V4 был повышен, но частота галлюцинаций увеличилась. V4-Pro набрал -10 в индексе комплексной оценки всеведения (AA-Всеведение), что на 11 пунктов выше, чем версия рассуждения V3.2. Ядро выиграло от значительной оптимизации точности ответов на знания. V4-Flash получил оценку -23, а общий уровень практически такой же, как у V3.2.

По сравнению с уровнем галлюцинаций V3.2 (82%), проблема галлюцинаций двух моделей V4 заметна: Уровень галлюцинаций V4-Pro составляет 94%, а уровень галлюцинаций V4-Flash 96%, что означает, что модель почти всегда будет принудительно генерировать ответы в неизвестных сценариях проблем.

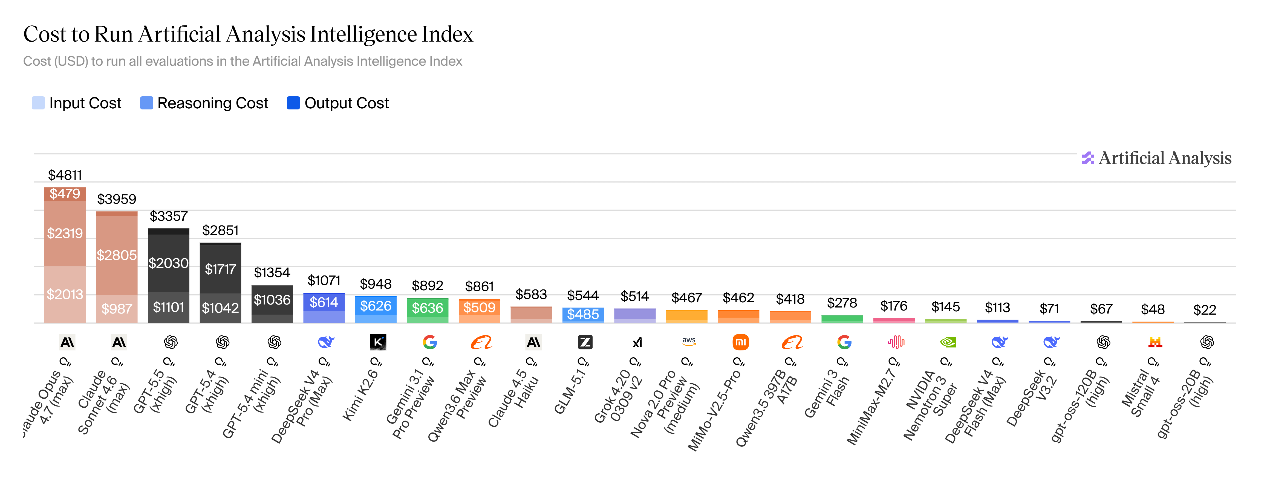

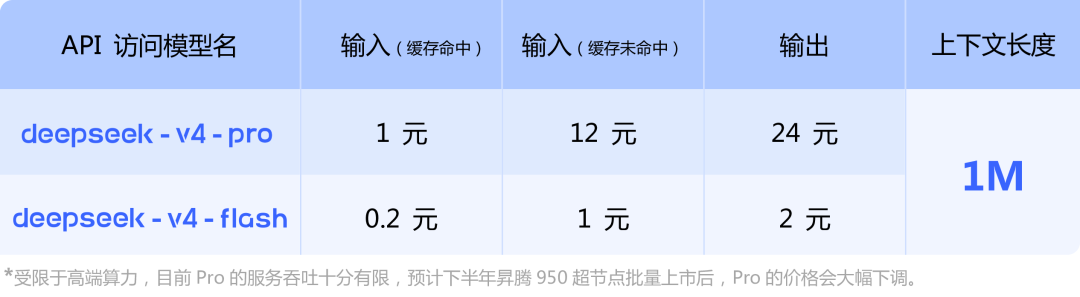

Эксплуатационные расходы DeepSeek-V4 ниже, чем у верхней модели с закрытым исходным кодом, выше, чем у основной модели с открытым исходным кодом, и значительно выросли по сравнению с предыдущим поколением. После выполнения полного набора оценок индекса интеллектуального анализа вручную эксплуатационные расходы V4-Pro составят 1071 доллар США, что составляет лишь менее четверти стоимости Claude Opus 4.7 (4811 долларов США); однако он все еще высок по сравнению с аналогичными моделями с открытым исходным кодом: выше, чем у Kimi K2.6 (948 долларов США), GLM-5.1 (544 доллара США), DeepSeek-V3.2 (71 доллар США) и gpt-oss-120B (67 долларов США). Эксплуатационные расходы DeepSeek-V4-Flash составляют всего около 113 долларов США, что дает значительное преимущество в цене.

После завершения стандартного процесса оценки выходное потребление токенов V4-Pro достигло 190 миллионов, что является одной из моделей с самым высоким потреблением токенов в этой оценке; Потребление V4-Flash выросло до 240 миллионов токенов. Даже если цена низкая, высокое потребление токенов по-прежнему является основной причиной того, почему общая стоимость использования V4-Pro выше, чем у других моделей с открытым исходным кодом.

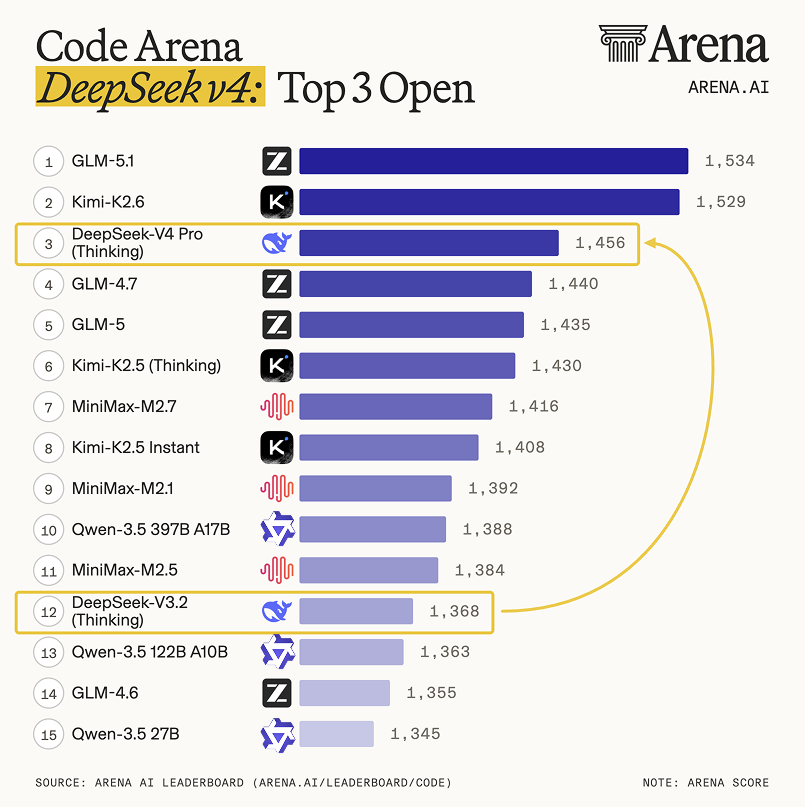

В других обзорах Большая модель Arena Arena.ai характеризует DeepSee k-V4-Pro как «большой скачок по сравнению с DeepSeek-V3.2» , занимает 3-е место среди моделей с открытым исходным кодом и 14-е место в целом по коду. DeepSeek-V4-Pro находится на одном уровне с GPT-5.4-high и Gemini-3.1-Pro в задачах веб-разработки агентов. В текстовой сфере DeepSeek-V4-Pro занял 2-е место среди моделей с открытым исходным кодом и 14-е место в общем зачете, как и Kimi-2.6. DeepSeek-V4-Flash занимает 10-е место среди моделей с открытым исходным кодом и 14-е место в целом.

Vals AI, еще одна оценочная группа, заявила, что DeepSeek-V4 занял первое место в модели веса с открытым исходным кодом с «подавляющим преимуществом» в тесте Vibe Code Benchmark (тест атмосферного кода). добился примерно 10-кратного прироста производительности по сравнению с предыдущим поколением V3.2, опередив даже таких процессоров, как Gemini. Лучшие модели с закрытым исходным кодом, такие как 3.1 Pro. DeepSeek-V4 также является единственной весовой моделью с открытым исходным кодом, которая превышает 40% по Vibe Code Benchmar.

По сравнению с возможностями DeepSeek-V4, зарубежные страны уделяют больше внимания сотрудничеству DeepSeek и Huawei.

В нижней части информации о ценах на API, объявленной DeepSeek-V4, в официальном уведомлении указывалось: «Ограниченная высокопроизводительной вычислительной мощностью, текущая пропускная способность сервиса Pro очень ограничена. Ожидается, что после массового запуска суперузлов Ascend 950 во второй половине года цена Pro будет значительно снижена».

DeepSeek заявил в техническом отчете, что V4 был запущен на NVIDIA. Решение мелкозернистого EP (экспертный параллелизм) было проверено на платформах GPU и Huawei Ascend NPU. По сравнению с мощным базовым уровнем без слияния, он может обеспечить эффект ускорения в 1,50–1,73 раза для общих задач рассуждения и может достичь эффекта ускорения в 1,96 раза в сценариях, чувствительных к задержкам (таких как вывод RL и высокоскоростные прокси-сервисы).

После выпуска V4 компания Huawei Ascend также одновременно объявила, что «весь ассортимент продуктов суперузла поддерживает модели серии DeepSeek-V4». Сообщается, что Ascend 950 снижает затраты на вычисление внимания и доступ к памяти за счет интеграции ядра и многопоточной параллельной технологии, значительного улучшения производительности вывода и объединения нескольких алгоритмов квантования для достижения высокой пропускной способности и низкой задержки развертывания вывода модели DeepSeek-V4.

Что касается сотрудничества DeepSeek с Huawei, Хэ Хуэй, директор по исследованиям полупроводников в Omdia, организации по исследованию рынка, сказал: «Это имеет большое значение для китайской индустрии искусственного интеллекта».

Далее он сказал: "Чип Huawei Ascend — это чип собственной разработки в Китае. Самый лучший продукт, который может заменить Nvidia. Большая модель DeepSeek-V4 адаптирована для оснащения чипами Huawei, что означает, что лучшая крупная модель Китая теперь может использовать локализованное оборудование.

Goldman Аналитик Sachs Кристофер Мониз отметил, что после выпуска предварительной версии DeepSeek-V4 сектор графических процессоров и отечественных чипов усилился. Одной из основных проблем является базовая архитектура чипов, которая поддерживает модель V4: включая чипы, используемые для обучения модели, и аппаратные устройства, используемые на этапе вывода. Вычислительный кластер нового поколения Huawei, оснащенный процессором Ascend AI, может быть адаптирован для работы с китайской моделью DeepSeek-V4. самостоятельно разработанная аппаратная экосистема искусственного интеллекта обеспечивает поддержку вычислительной мощности для продолжающейся итерации передовых больших моделей DeepSeek

.Этот сдвиг в технологическом маршруте DeepSeek также подтверждает предыдущие опасения генерального директора Nvidia Джен-Сюнь Хуанга: Nvidia рискует потерять экосистему китайских разработчиков.

Ранее в этом месяце основатель NVIDIA Хуан Дженсен принял Dwarkesh. В эксклюзивном интервью Патель однажды сказал: «Если DeepSeek сначала будет выпущен на платформе Huawei, это будет катастрофой для Соединенных Штатов». По мнению Хуан Ренсюня, хотя DeepSeek является моделью с открытым исходным кодом и может также использоваться в продуктах NVIDIA, если DeepSeek специально оптимизирован для вычислительной мощности Huawei, NVIDIA окажется в невыгодном положении из-за таких ограничений, как ограничения на покупку высокопроизводительных вычислительных мощностей.

В отличие от DeepSeek-R1, DeepSeek-V4 не вызвал резкого падения акций технологических компаний США. Старший аналитик по акциям Morningstar Иван Су сказал, что DeepSeek-V4 сложно воспроизвести первоначальное рыночное влияние модели вывода R1 , поскольку торговый рынок уже полностью оправдал ожидания: китайская технология искусственного интеллекта конкурентоспособна и имеет более низкие затраты на использование.

Иван Су также сказал, что позиционирование нового продукта DeepSeek напрямую отнесло другие крупные отечественные модели с открытым исходным кодом к разряду конкурирующих продуктов.

Исследователь Брукингского института Кайл Чан сказал, что DeepSeek-V4 впечатляет, потому что это почти современная модель с эффективной длиной контекста в 1 миллион токенов, которая может работать на новых чипах Huawei. DeepSeek-V4 не повторил «момент DeepSeek-R1», поскольку ожидания внешнего мира в отношении возможностей искусственного интеллекта Китая намного выше, чем раньше.