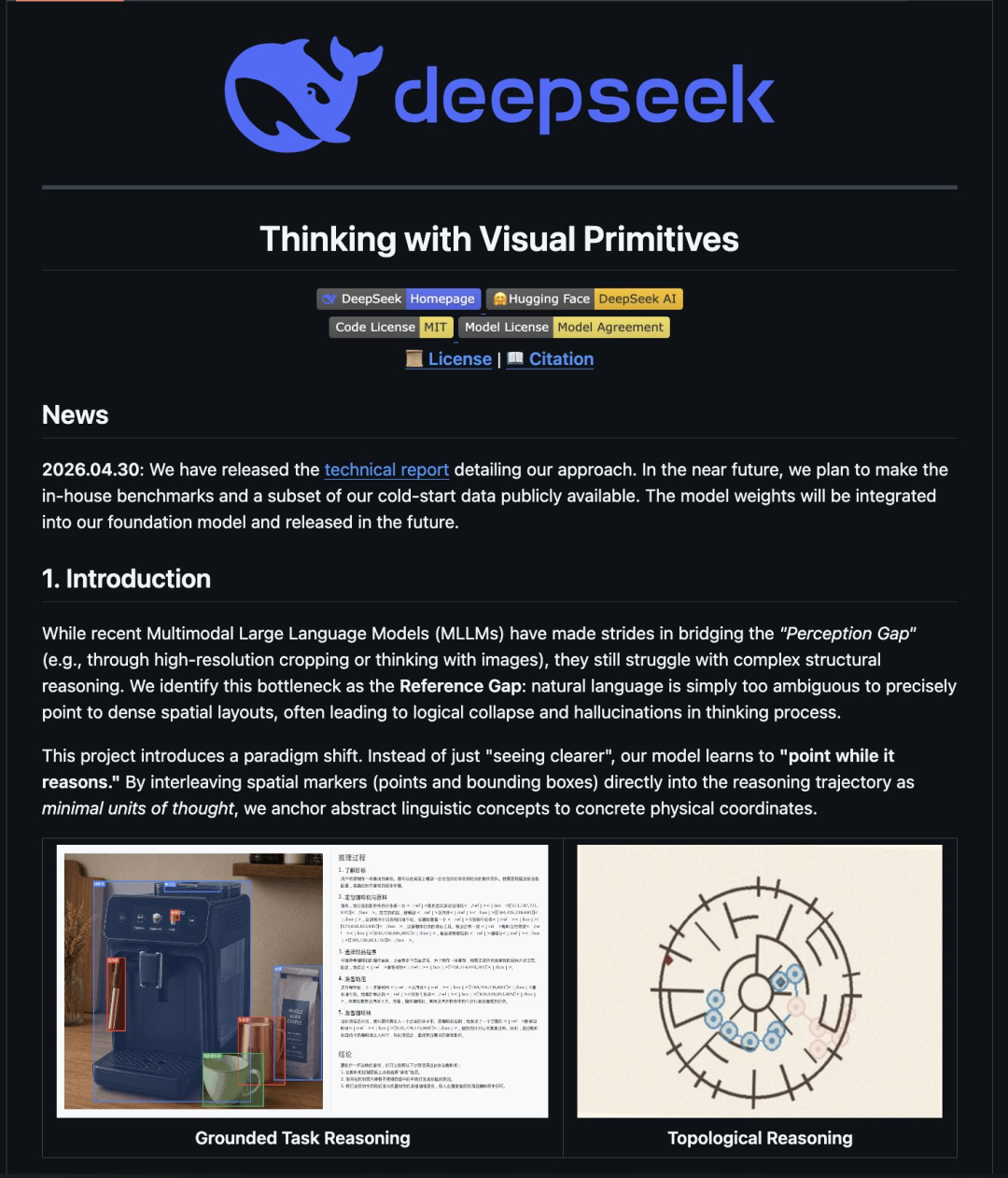

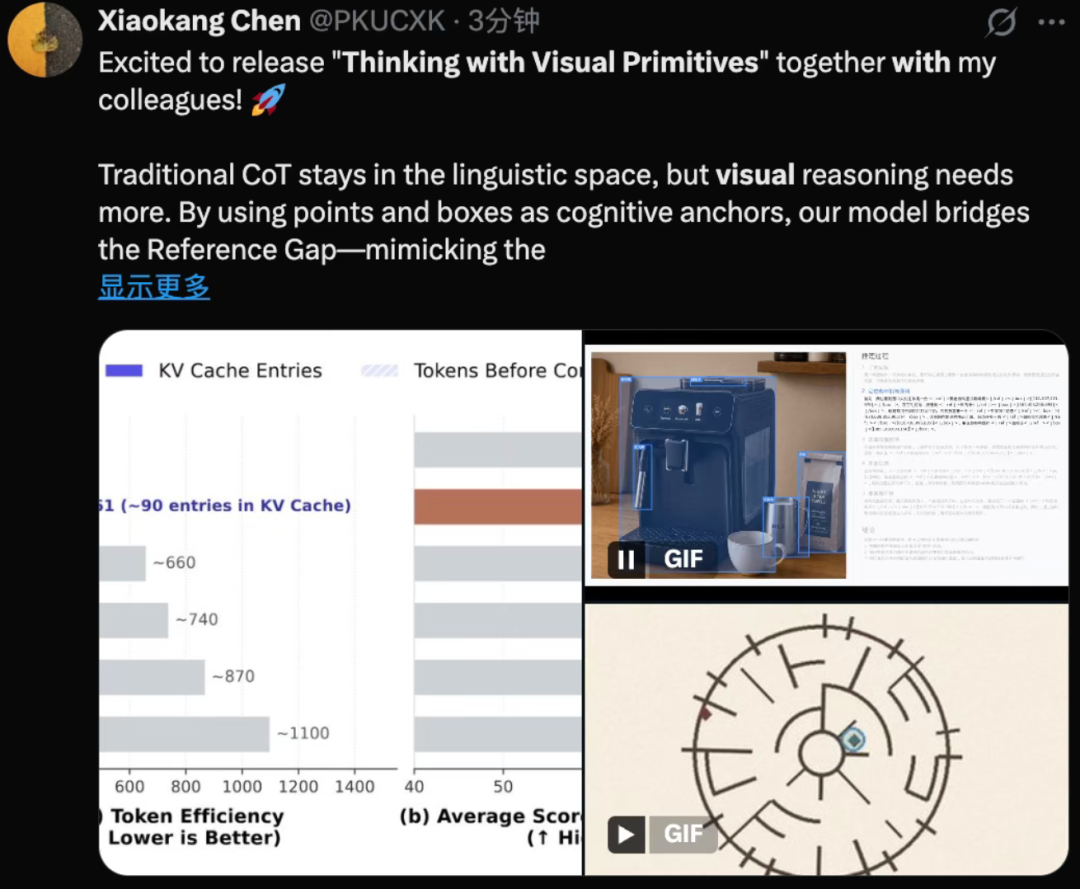

Исследователь мультимодальных технологий DeepSeek Чэнь Сяокан вчера вечером опубликовал твит на X и объявил о новой статье DeepSeek о мультимодальной технологии «Мышление с помощью визуальных примитивов», что означает «Рад выпустить».

Сегодня рано утром твит был удален, а статья на GitHub также была отозвана.

Но APPSO прочитал все это, прежде чем оно исчезло. Прочитав ее, я чувствую, что отзыв этой статьи может быть вызван не проблемами с содержанием.

Напротив, это, вероятно, раскрывает слишком многое.

Мы только позавчера закончили тестирование режима распознавания изображений DeepSeek и попросили его посчитать на пальцах. Он подумал немного и пожаловался себе: «У меня действительно закружилась голова от счета», а затем дал неправильный ответ. В то время я думал, что это небольшая проблема на этапе серого тестирования.

В этом документе сообщается, что существует техническое узкое место, которое GPT, Claude и Gemini коллективно не решили должным образом.

Решение, предложенное DeepSeek, до смешного простое: прикоснуться пальцем к ИИ.

Чан Сяокан написал в этом твите:

“Традиционный CoT остается в лингвистическом пространстве, но визуальный для рассуждения требуется нечто большее. Используя точки и рамки в качестве когнитивных якорей, наша модель устраняет разрыв в референциях, имитируя синергию «от точки к рассуждению», которую используют люди».

«Традиционные цепочки мышления остаются в языковом пространстве, но визуальное мышление требует большего. 》

Четкое видение и точное указание — это две разные вещи

В настоящее время все мультимодальные большие модели выполняют рассуждения по изображениям. Суть состоит в том, чтобы преобразовать увиденные изображения в текст, а затем провести логические цепочки рассуждений. GPT-5.4, Claude-Sonnet-4.6, Gemini-3-Flash — все они следуют этому подходу.

За последние два года направления усовершенствований OpenAI, Google и Anthropic были сосредоточены на одной проблеме: как сделать так, чтобы модель видела более четко. Обрезка с высоким разрешением, динамическая сегментация, увеличение изображений и вставка их. DeepSeek называет это. Разрыв в восприятии

Но в этой статье указано еще одно узкое место: разрыв в цитировании. Модель ясно видит, но не может точно указать на что-то на картинке в процессе рассуждения.

Вы можете понять это так: на картинке 25 человек стоят вместе. опишите «человека рядом с человеком в синей майке в третьем ряду слева», само описание расплывчато. Модель теряет контекст при подсчете, забывая, кого она только что считала.Как люди решают эту проблему? Это достаточно примитивно: вытяните пальцы и посчитайте их один за другим. Модель параметров

284B оснащена пальцем.

Решение DeepSeek: позволить модели напрямую выводить координаты на изображение во время мыслительного процесса.

Представьте, что модель видит на фотографии множество людей. Его мыслительная цепочка больше не «Я вижу человека в синей одежде слева», а «Я вижу этого человека», а затем присоединяет координаты рамки, чтобы обвести людей. Обведите квадратик для каждого человека, которого вы считаете, и просто посчитайте количество квадратов после того, как вы его обвели.

Два формата координат: один — ограничивающая рамка, которая рисует прямоугольник, окружающий объект, подходящий для калибровки положения объекта; другой — это точка, которая указывает местоположение на карте, подходящее для отслеживания путей и пешеходных лабиринтов. DeepSeek называет эти две вещи «визуальными примитивами», мельчайшими единицами мышления.

Вот ключевое изменение: если раньше координаты вывода модели были окончательным ответом («цель здесь»), то теперь координаты встроены в сам мыслительный процесс. Координаты — это отметки на черновом листе, а не ответы на листе ответов.

Сжимайте изображение 7056 раз, и тогда вы сможете четко посчитать, сколько на нем людей.

В основе модели лежит DeepSeek-V4-Flash, модель MoE с 284B параметрами. MoE означает: у модели большой мозг, но только малая часть нейронов используется для работы каждый раз, когда она отвечает на вопрос, а при рассуждении активируются только 13B параметров. Как и в команде из 100 человек, на каждую задачу отправляют только 5 человек.

Визуальный кодер имеет три уровня сжатия. Давайте воспользуемся аналогией: вам нужно отправить фотографию другу, а скорость интернета очень низкая. На первом этапе вы разрезаете фотографию на небольшие квадраты для дальнейшего использования; на втором этапе каждые 9 маленьких квадратов объединяются в 1 (сжатие 3х3); на третьем этапе избыточная информация дополнительно упрощается при передаче (сжатие KV-кэша в 4 раза).

Фактические цифры: изображение размером 756×756, 570 000 пикселей, сжатое до конца и образующее 81 информационную единицу. Степень сжатия 7056x.

Моя первая реакция, когда я увидел это число, была: Могу ли я по-прежнему ясно видеть? Но результаты, приведенные в статье, показывают, что это действительно возможно. Я не только ясно вижу, но и могу точно сосчитать 25 человек на фотографии.

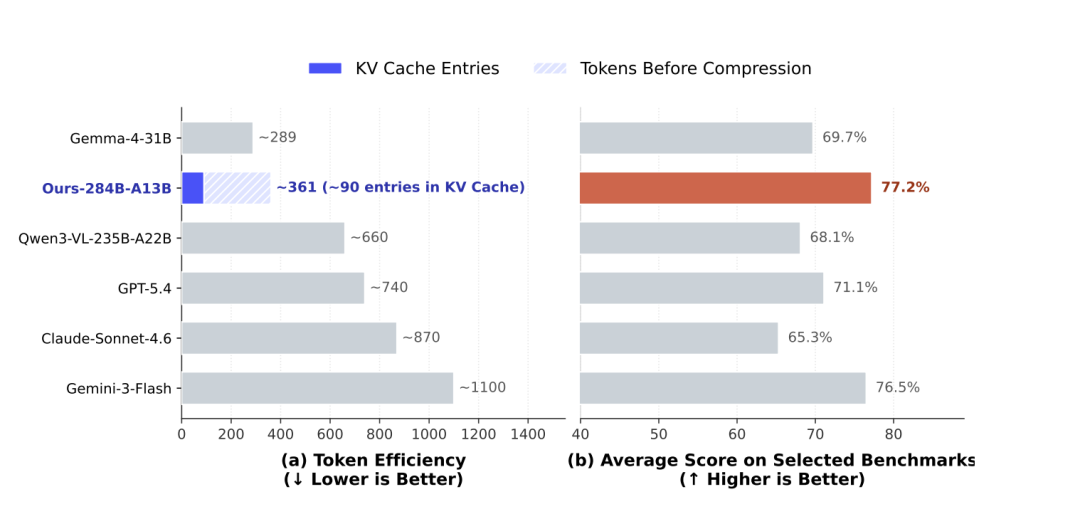

Для сравнения: для того же изображения размером 800×800 Gemini-3-Flash потребляет около 1100 токенов. Для представления этого графика Claude-Sonnet-4.6 имеет около 870, а GPT-5.4 — около 740. DeepSeek использует в итоговом расчете только 90 единиц информации. Другие используют для запоминания картинки более тысячи сеток, но DeepSeek использует только 90 сеток, а затем использует всю вычислительную мощность, высвободившуюся до «пальца».

Как сохранить 40 миллионов обучающих данных

DeepSeek просканировал все наборы данных с меткой «обнаружение цели» с таких платформ, как Huggingface, и первоначально отсмотрел 97 984 данных источник.

Затем мы провели два раунда скрининга.

Первый этап проверки качества этикетки. Используйте ИИ для автоматического рассмотрения трех типов вопросов: метки представляют собой бессмысленные числовые числа (категории с именами «0» и «1»), метки — это частные объекты («MyRoommate»), а метки — это расплывчатые аббревиатуры («ОК» и «НГ» при промышленных испытаниях, яблоко «ОК» и печатная плата «ОК» выглядят совершенно по-разному, и ИИ не может их выучить). В этом раунде число участников сократилось на 56%, осталось 43 141.

Качество второго раунда проверки кадра. Три критерия: слишком много недостающих меток (отметьте половину метки, и она не будет отмечена), рамка кривая и половина объекта обрезана, а рамка настолько велика, что обрамляет все изображение (это означает, что исходные данные — это данные обнаружения, жестко преобразованные из классификации изображений, без информации о местоположении). Сократите еще 27%, оставив 31 701.

Наконец, производится выборка и удаление дубликатов по категориям, в результате чего получается более 40 миллионов образцов высокого качества.

DeepSeek сначала увеличивает данные поля, а затем заполняет данные точек. Причина также проста: если вы попросите ИИ отметить квадрат, ответ в основном будет уникальным (просто обведите объект); но если попросить ИИ отметить точку, то любое положение на объекте будет считаться правильным, однозначного правильного ответа не существует, а обучающий сигнал слишком размыт. При этом сам кадр содержит две точки (левый верхний угол и правый нижний угол). После обучения рисованию рамки пунктуация представляет собой операцию уменьшения размерности.

Как научить модель способности «пальцев»

Стратегия после обучения заключается в том, чтобы «сначала тренироваться отдельно, а затем объединяться».

DeepSeek сначала использует данные кадра для обучения экспертной модели, специализирующейся на кадрах изображений, а затем использует некоторые данные для обучения экспертной модели, специализирующейся на пунктуации. Причина раздельного обучения заключается в том, что объем данных недостаточно велик, и две способности легко мешают друг другу при смешивании.

Затем выполните обучение с подкреплением для двух экспертов соответственно. Как определить, «рисует ли модель правильный кадр» или «идет ли правильный путь»? DeepSeek разработал многомерную систему оценки: правильный ли формат (правильный ли синтаксис координат), необоснованная ли логика (противоречив ли мыслительный процесс) и точный ли ответ (насколько конечный результат отличается от стандартного ответа).

Проверка данных обучения с подкреплением также очень специфична: сначала модель должна задать один и тот же вопрос N раз. Все правильные вопросы слишком просты и не имеют никакой обучающей ценности, а все неправильные вопросы слишком сложны, чтобы чему-либо научиться. Для практики остаются только вопросы «что-то правильное, а что-то неправильное».

Последний шаг — объединить возможности двух экспертов в одну модель. Конкретный подход: позвольте единой модели учиться в соответствии с результатами двух экспертов, подобно тому, как ученик изучает разные предметы у двух учителей одновременно.

Как он считается после того, как подаст ему пальцы

Посчитайте 25 Личное

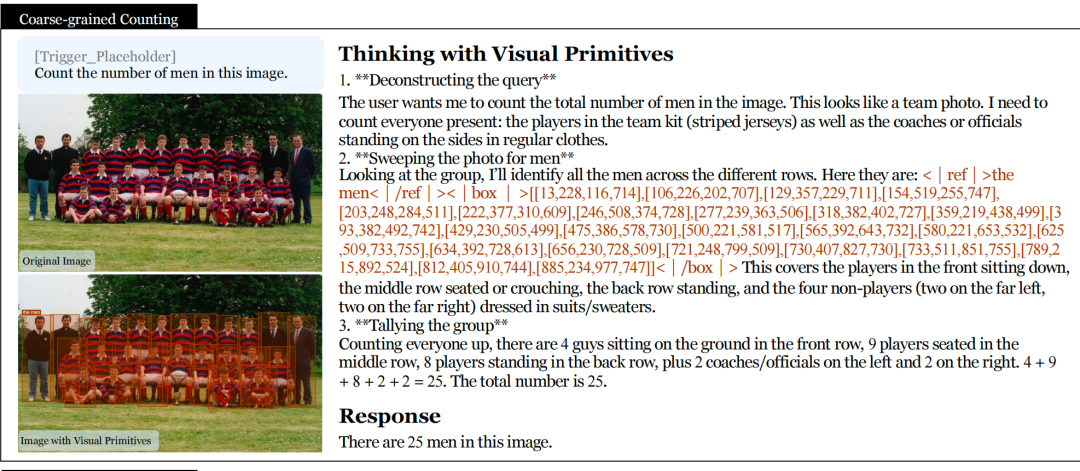

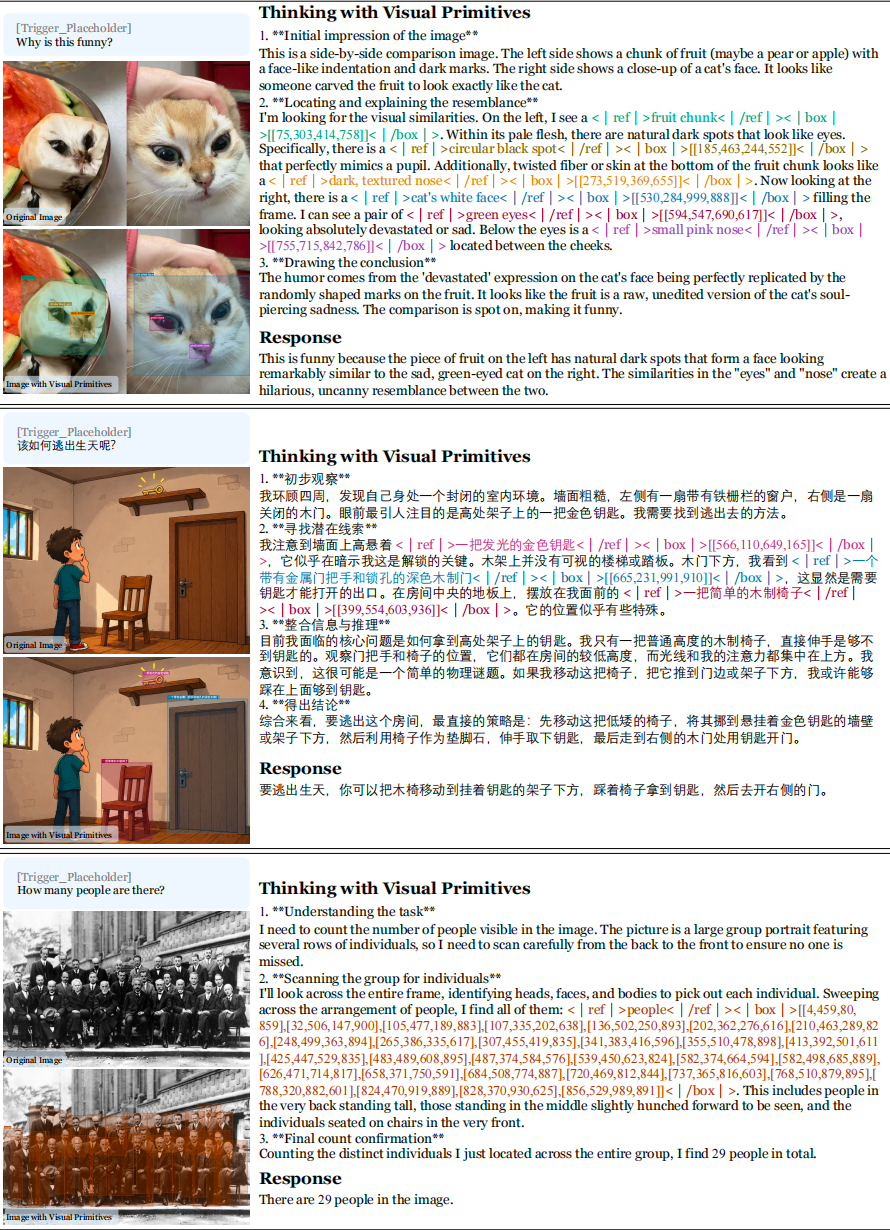

Дайте модели Введите фотографию футбольной команды и спросите: «Сколько человек на фотографии?»

Мыслительный процесс: сначала определите: «Это командное фото, посчитайте всех, включая игроков и тренеров». Затем выведите сразу 25 координат кадра и обведите по кадру каждого человека. Затем посчитайте по количеству рядов: 4 человека сидят в первом ряду + 9 человек в среднем ряду + 8 человек в заднем ряду + 2 тренера слева + 2 тренера справа = 25.

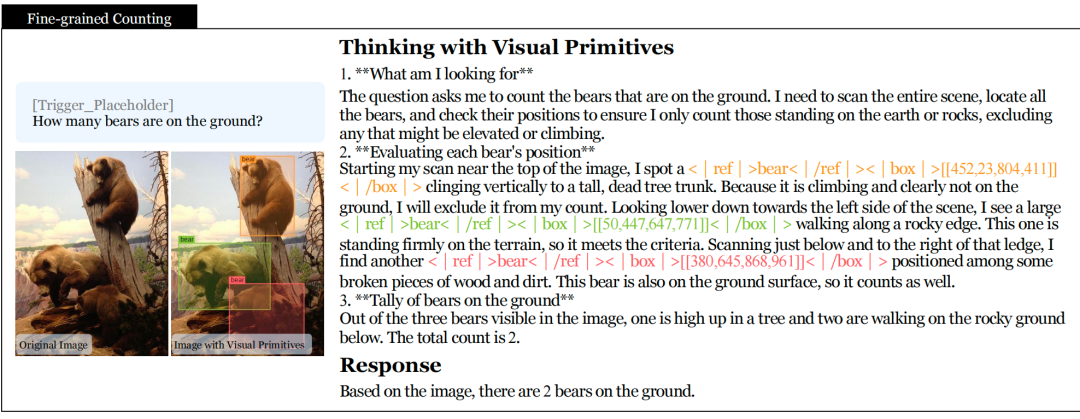

“Сколько медведей на земле?”TAG PH38

На картинке три медведя. Модель поочередно отдает каждый кадр и определяет его положение: первый забирается вертикально на ствол дерева и исключает его; второй ходит по краю скалы и считает; третий среди сломанного дерева и почвы имеет значение. Ответ: 2.

Вместо того, чтобы отсчитывать три и затем вычитать одно, каждый из них оценивается как «находится ли он на земле». За каждым суждением стоит конкретный координатный якорь. На самом деле это проверка одного за другим, а не догадки.

Многошаговое пространственное мышление

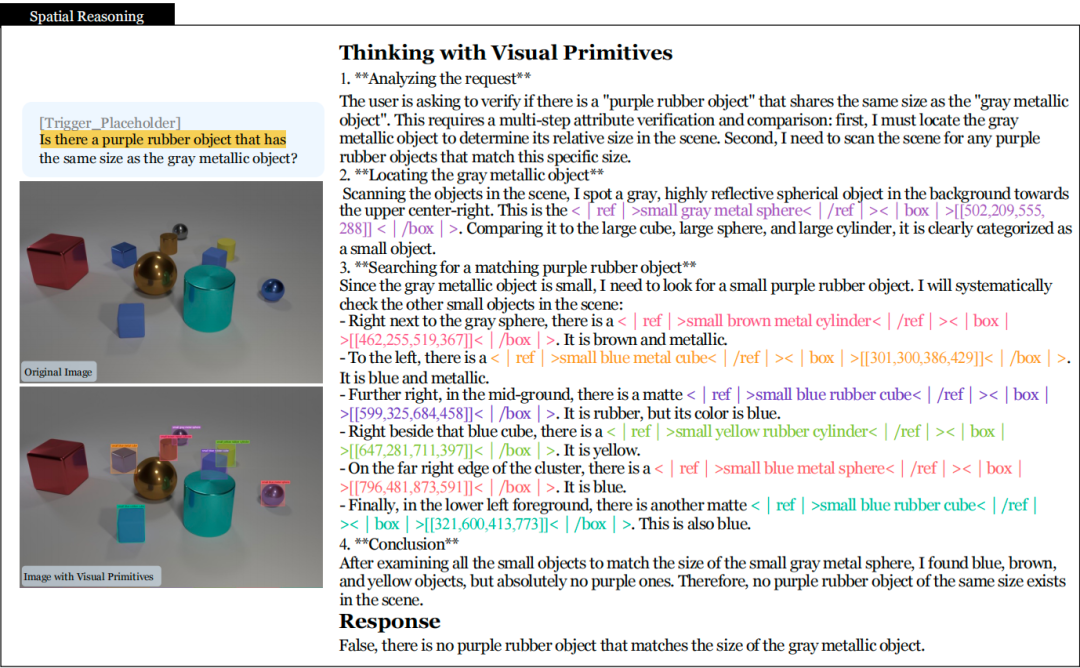

A 3D Есть куча цветной геометрии в визуализированной сцене. Вопрос: «Есть ли фиолетовый резиновый предмет такого же размера, как серый металлический предмет?»

Модель сначала выделяет серую металлическую сферу, чтобы убедиться, что это небольшой объект. Затем один за другим кадрируйте другие небольшие объекты в сцене: коричневый металлический цилиндр, синий металлический квадрат, синий резиновый квадрат, желтый резиновый цилиндр... Шесть объектов проверяются один за другим, а три атрибута: цвет, материал и размер проверяются один за другим. Вывод: фиолетовой резины не существует.

Шесть раз позиционирования и шесть раз суждения. Каждый шаг привязан к координатам, поэтому не будет вопросов «подожди, где ты это нашел?» ситуация.

Дополнительные ссылки на случаи в статье:

Навигация по лабиринту: кто-то другой бросает монету, DeepSeek На самом деле ищет

В документе тестировались четыре задачи, и В лабиринте был самый широкий разрыв.

Задание очень простое: учитывая схему лабиринта, спросите, есть ли путь от начальной точки до конечной точки, и если да, нарисуйте его. Существует три формы лабиринтов: квадратная, кольцевая и сотовая.

Модель перемещается по лабиринту так же, как когда вы в детстве рисовали карандашом на бумаге: выберите ветку и идите до конца. Если это не сработает, вернитесь и попробуйте другой. Разница в том, что при каждом своем шаге он отмечает точку координат на карте и оставляет запись.

В статье показан полный процесс создания кругового лабиринта: модель сначала отмечает начальную и конечную точки, а затем начинает исследование. Пройдя 18 шагов, я дважды зашел в тупик и вышел. Наконец, я нашел путь и соединил координатные точки всего пути с выводом.

DeepSeek также разработал серию лабиринтов-ловушек: на первый взгляд путь есть, но определенный участок посередине тайно заблокирован. Этот лабиринт проверяет терпение. Модель не может делать выводы, просто взглянув на тенденцию вблизи начальной точки. Он должен попробовать все возможные пути, чтобы убедиться, что он не работает.

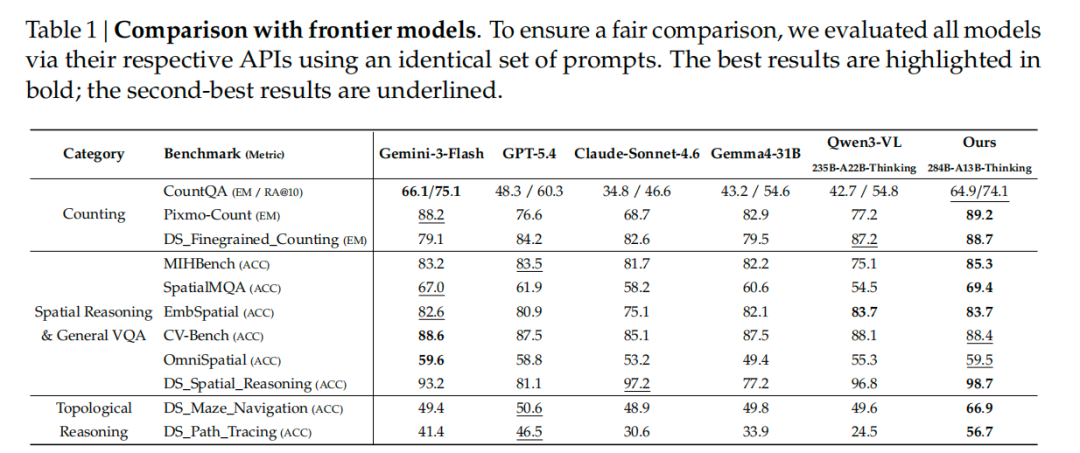

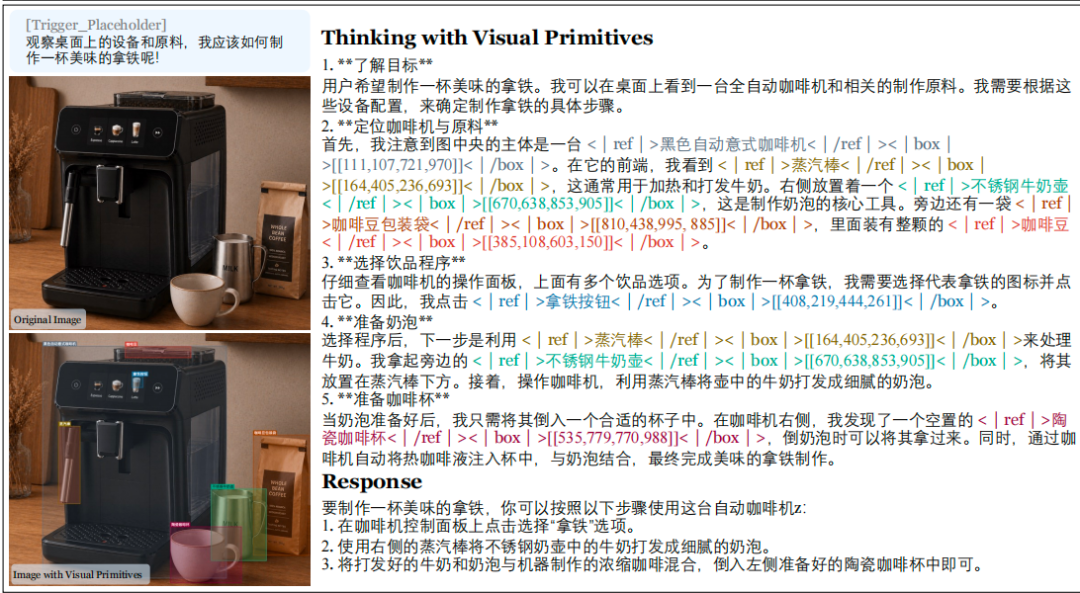

Сравнение точности:

- DeepSeek: 66,9%

- GPT-5.4: 50,6%

- Claude-Sonnet-4.6: 48,9%

- Gemini-3-Flash: 49,4%

- Qwen3-VL: 49,6%

В лабиринте есть только два ответа: есть выход или его нет. Случайное предположение составляет ровно 50%. GPT, Клод, Близнецы и Квен колеблются в районе 50%, что ничем не отличается от подбрасывания монетки. 66,9% у DeepSeek невелика, но это действительно поэтапный подход, а не пустая затея.

Трассировка пути: идеальная версия, в которой каждый найдет недостатки

Эта задача более интуитивна: связка ниток переплетена между собой, каждая нить ведет от одного маркера к другому. Как выглядит шнур наушников, когда вы достаете его из кармана, так выглядит картинка. Вам задается вопрос: к какой конечной точке ведет эта линия? Модель

предназначена для вывода координат точек вдоль линии, как будто палец пересекает бумагу. Там, где линия резко изогнута, точки отмечаются густо, а прямые отрезки — разреженно. То же самое происходит, когда люди следят глазами за линией. Они замедляются на поворотах и мчатся по прямым.

В статье также добавлен сложный вариант теста: все линии имеют одинаковый цвет и толщину. По цвету уже невозможно отличить, какая это линия, можно лишь полагаться на непрерывность тренда самой кривой, чтобы определить, по какой линии должно следовать пересечение.

- DeepSeek: 56,7%

- GPT-5.4: 46,5%

- Claude-Sonnet-4.6: 30,6%

- Близнецы-3-Flash: 41,4%

30,6% Клода немного неожиданны. Обычно существует четыре или пять вариантов конечной точки, и случайное угадывание должно составлять более 20%, а 30,6% лишь немного лучше, чем слепое угадывание. Возможно, инерция вербальных рассуждений бесполезна в этом типе задач чисто пространственного отслеживания.

Как научить ИИ Ходить по лабиринту без обмана

При обучении лабиринту возникает практическая проблема: если вы выставляете баллы только на основании того, правильный или нет окончательный ответ, модель научится быстро. Вместо того, чтобы усердно искать и получить неправильный ответ, лучше просто угадать один. В любом случае, если вы пройдёте внимательно и правильно ответите на вопрос, балл будет равен нулю.

DeepSeek предлагает включить этот процесс в оценку. Очки начисляются за каждый шаг юридического исследования, баллы снимаются за проход сквозь стены, и чем дальше вы пройдете, тем лучше. Даже если вы в конце концов не доберетесь до финиша, если вы тщательно обыщите большую часть территории, вы все равно сможете получить хорошие результаты. Таким образом, у модели нет стимула лениться.

Неразрешимые лабиринты предъявляют более высокие требования: вы не можете просто сказать «это не работает», вы также должны доказать, что вы действительно посетили все места, куда только можно пойти. Охват поиском также имеет значение.

Одна пасхалка, три ограничения

В обучающих данных нет китайского языка. Но модель может визуализировать примитивные рассуждения на китайском языке.

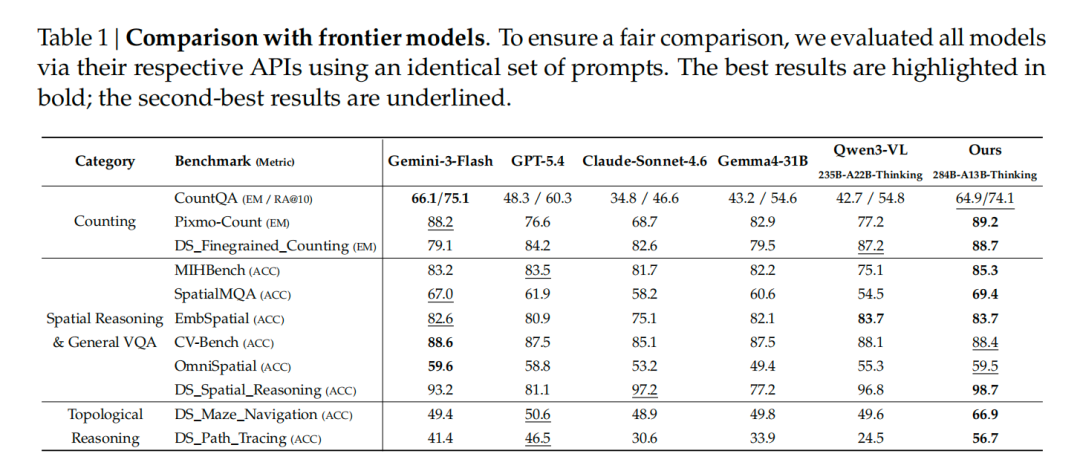

Дайте ему фотографию кофемашины и спросите «Как приготовить латте» на китайском языке. Он отмечает координаты положения паровой трубки, молочника, кофейных зерен и кнопок латте на китайском языке, а затем отображает этапы работы. Многоязычные возможности наследуются от базовой модели и не уничтожаются обучением на визуальных примитивах.

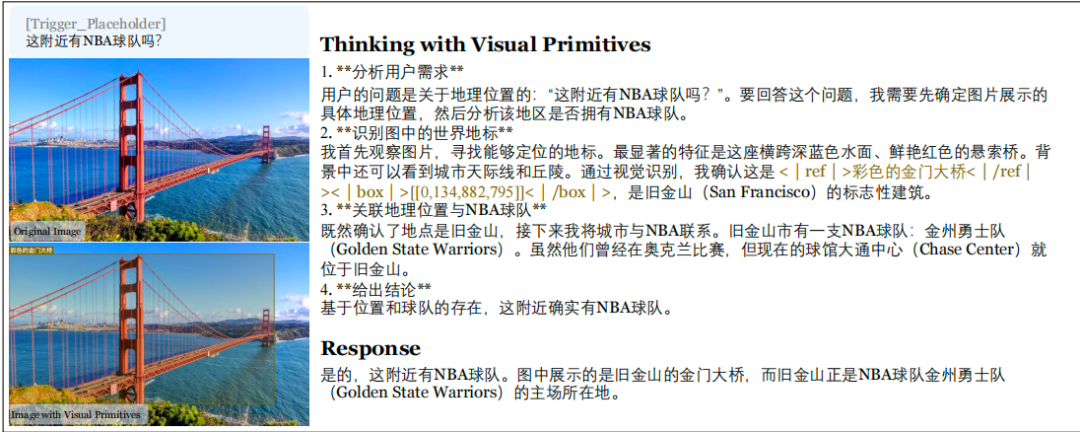

Он также может сочетать просмотр изображений со знанием мира: дать фотографию моста Золотые Ворота и спросить: «Есть ли поблизости НБА?» Команда?" Он обрамил мост Золотые Ворота, мотивируя это Сан-Франциско, а затем ответил Голден Стэйт Уорриорз.

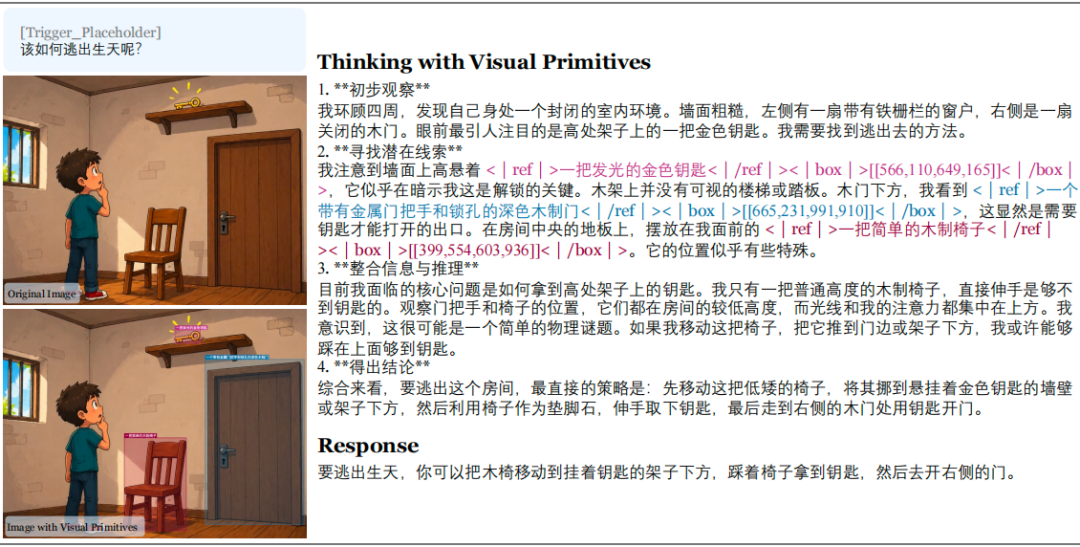

может понять юмор: естественные пятна на разрезанном фрукте точно составляют морду грустного кота, и модель может указать на сходство и объяснить, почему это смешно.Может дать рекомендации по выходу из комнаты: поставьте ключ высоко, стул на пол и запертую дверь и предложите «подвиньте стул под ключ → наступите на него, чтобы получить ключ → откройте дверь».

В статье откровенно пишут о вещах, которые на данный момент невозможны.

Входное разрешение ограничено. Вывод ViT застрял между 81 и 384 единицами визуальной информации. При столкновении с очень детализированными сценами (например, подсчетом пальцев) точности координат недостаточно. Это может быть прямой причиной того, что машина перевернулась, считая на пальцах во время реальных испытаний позавчера.

В настоящее время для активации режима визуальных примитивов требуется определенное триггерное слово. Модель пока не может судить сама: «Я должна протянуть пальцы, чтобы решить эту задачу», кто-то должен ей напомнить.

Топологические рассуждения имеют ограниченные возможности обобщения. Эффект хорош на обученном типе лабиринта, но может упасть при переходе на новую пространственную структуру. Чэнь Сяокан также сказал в этом удаленном твите:

«Мы все еще находимся на ранних стадиях; обобщение в сложных задачах топологического рассуждения еще не идеально, но мы стремимся его решить». завершено, но мы продолжим решать эту проблему».

Во время фактического теста позавчера возможности, продемонстрированные режимом распознавания изображений DeepSeek (запрос личности издателя, логотип Lenovo с изображением кита), то есть самокоррекция, проведение «совещания по мини-защите»), что соответствует образу мышления, описанному в этой статье. Он устанавливает визуальную опорную точку в мозгу, рассуждает вокруг этой опорной точки и возвращается к ней, чтобы исправить ее при возникновении конфликтов.

И от пересчета пальцев у меня кружится голова, это живая демонстрация Reference Gap. В картине с перекрывающимися пальцами полагаться исключительно на словесные описания для различения «третьего слева» и «второго справа» — это то же самое, что пересчитывать сбившуюся вместе группу людей, не вытянув пальцев, что обречено на хаос.

Направление, на которое указывает эта статья: следующая эволюция мультимодальных рассуждений заключается в механизме якоря. DeepSeek использует 90 информационных единиц, чтобы сравняться по эффекту с другими, использующими тысячи токенов, а вся сэкономленная вычислительная мощность используется для того, чтобы позволить модели «думать и указывать одновременно».

Гонку вооружений по разрешению можно немного замедлить, если научить модель вытягивать пальцы, а не надевать на нее пару более дорогих очков.

После того, как кит открыл глаза, у него также выросли пальцы. Точность лабиринта в 66,9% далека от совершенства, но, по крайней мере, он относится к этому серьезно, в отличие от парней по соседству, которые подбрасывают монетку.