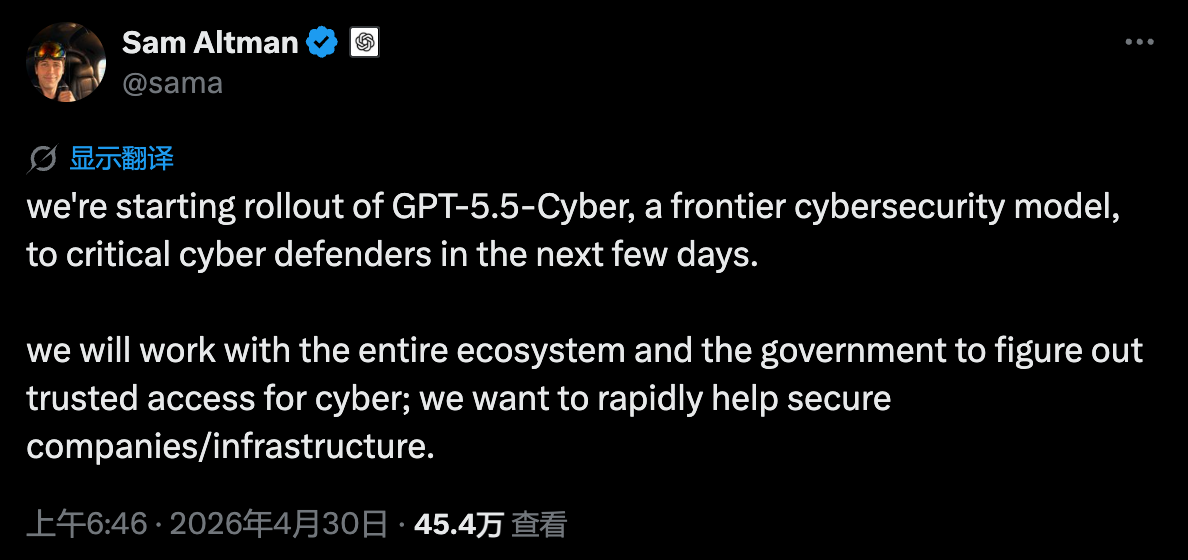

OpenAI готовится к запуску новой передовой модели сетевой безопасности GPT-5.5-Cyber. Генеральный директор компании Сэм Альтман заявил, что эта модель не будет открыта для общественности, но сначала будет предоставлена группе проверенных и заслуживающих доверия «киберзащитников», чтобы помочь соответствующим учреждениям укрепить свои собственные возможности защиты сетевой безопасности.

По словам Альтмана о платформе. В то же время OpenAI также будет сотрудничать со всей отраслевой экосистемой и правительством США, чтобы изучить, как создать механизм «доверенного доступа» для области сетевой безопасности.

В настоящее время OpenAI еще не определила первую партию конкретных объектов для получения прав на использование. Однако, судя по ранее запущенной компанией программе «Доверенный доступ», соответствующие механизмы обычно предназначены для проверенных специалистов и учреждений. Что касается технических деталей, границ возможностей и конкретных характеристик самого GPT-5.5-Cyber, OpenAI пока не раскрывает никакой дополнительной информации.

Судя по названию, GPT-5.5-Cyber, скорее всего, будет специализированной версией недавно выпущенного GPT-5.5. OpenAI ранее описывала GPT-5.5 как свою «самую умную, интуитивно понятную и простую в использовании» модель на данный момент. Поэтому обычно считается, что GPT-5.5-Cyber будет производным продуктом на основе этой основы, который будет ориентирован на сценарии сетевой безопасности для целевого усиления.

Выпуск моделей с высокими возможностями поэтапно и в небольших масштабах становится все более очевидной тенденцией в индустрии искусственного интеллекта. Многие компании начали подчеркивать, что их самые продвинутые модели не подходят для полной открытости для публики из-за риска злоупотреблений. OpenAI ранее приняла стратегию пакетного выпуска для своих моделей, ориентированных на сетевую безопасность; Помимо сетевой безопасности, недавно выпущенная компанией специально для медико-биологических наук модель GPT-Rosalind также является продуктом, предназначенным для конкретных высокочувствительных областей, в основном обслуживающих биологические исследования и разработку лекарств.

В этом месяце компания Anthropic пошла по тому же пути, запустив Claude Mythos и активно продвигая свой высокобарьерный, безопасный и контролируемый метод выпуска. Однако Anthropic допустила довольно досадные ошибки в процессе выпуска безопасности модели, из-за чего соответствующие договоренности однажды стали спорными.

В отчете также упоминается, что, несмотря на предыдущую напряженность между Белым домом и Anthropic по вопросам, связанным с Пентагоном, правительство США по-прежнему уделяет пристальное внимание процессу запуска Mythos. По данным «Wall Street Journal», Белый дом недавно даже выступил против дальнейшего расширения сферы доступа к Mythos. Это также отражает то, что правительство США демонстрирует все более прямое и осторожное вмешательство в выпуск моделей искусственного интеллекта высокой производительности, которые могут представлять угрозу безопасности.