DeepSeek опубликовал на GitHub мультимодальную модель рассуждения и технический отчет под названием «Мышление с помощью визуальных примитивов (Thinking with Visual Primitives)». Эта модель построена на основе DeepSeek V4-Flash (всего 284B параметров, 13B архитектура MoE, активируемая во время вывода) и предлагает новую парадигму мультимодального рассуждения.

В статье указывается, что в существующих мультимодальных больших моделях существует фундаментальное узкое место, которое игнорируется: «эталонный разрыв» (Reference Gap), то есть модель может «видеть» содержание изображения, но при использовании естественный язык для построения цепочки мыслей в процессе рассуждения, расплывчатые описания, такие как большой красный объект слева рядом с центром, не могут точно определить местонахождение визуального объекта в плотной сцене, что приводит к рассеянию внимания и неправильным выводам.

Раньше основным направлением реагирования в академическом сообществе было улучшение разрешения восприятия, но в документе полагают, что видеть и уметь ясно понимать, что говорится, — это две разные вещи.

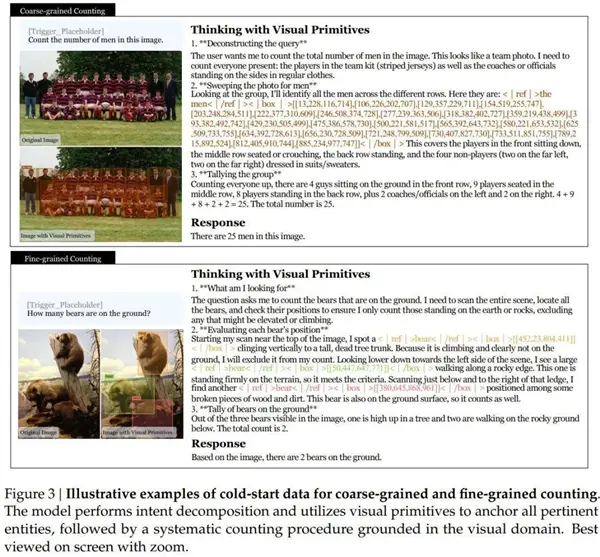

Основное нововведение этой модели заключается во встраивании координат точек и ограничивающих рамок в сам процесс рассуждения, что делает их базовой единицей мыслительной цепочки. Каждый раз, когда модель упоминает визуальный объект во время вывода, его координаты выводятся синхронно.

Например, «Найдите медведя [452, 23, 804, 411], забравшегося на дерево, исключите его, затем посмотрите вниз налево и найдите другого [50, 447, 647, 771], стоящего на краю скалы и отвечающего условиям». Координаты больше не являются ответами, отмеченными постфактум, а являются пространственными привязками, позволяющими устранить двусмысленность в процессе рассуждения.

На архитектурном уровне модель обеспечивает визуальное сжатие в 7056 раз, изображение размером 756×756. После обработки ViT было сгенерировано 2916 токенов блоков изображений, которые были объединены в 324 токена посредством пространственного сжатия 3×3. Кэш KV был дополнительно сжат 4 раза с помощью механизма Compressed Sparse Attention (CSA), и в итоге осталась только 81 визуальная запись KV.

Для справки: для изображения того же размера Claude Sonnet 4.6 требуется около 870 штук, а для Gemini-3-Flash — около 1100 штук.

Что касается обучающих данных, команда отобрала около 31 700 высококачественных источников данных из почти 100 000 наборов данных обнаружения целей и создала более 40 миллионов обучающих выборок, охватывающих четыре типа задач: подсчет, пространственное мышление, навигация по лабиринту и отслеживание пути.

После обучения сначала применяется стратегия экспертизации, а затем стратегия унификации. Две экспертные модели, ограничивающая рамка и координаты точки, обучаются отдельно. После оптимизации обучения с подкреплением они объединяются в единую модель посредством онлайн-анализа политик.

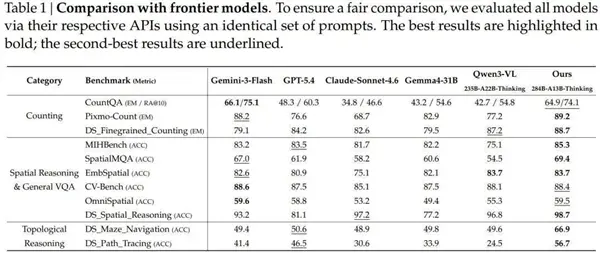

Экспериментальные результаты сравнивались с основными моделями, такими как Gemini-3-Flash, GPT-5.4 и Claude Sonnet 4.6, в 11 тестах производительности.

В задаче подсчета точный результат совпадения Pixmo-Count составляет 89,2%, что превышает показатель Gemini-3-Flash. 88,2%, что значительно опережает 76,6% GPT-5.4 и 68,7% Клода в Sonnet 4.6.

Наиболее представительный разрыв проявляется в топологических рассуждениях: оценка навигации по лабиринту — 66,9%, GPT-5,4 — 50,6%, Gemini-3-Flash — 49,4%, Claude Sonnet 4,6 — 48,9%, рост примерно на 17 процентных пунктов; показатель отслеживания пути — 56,7%, GPT-5.4 — 46,5%.

Однако в документе также указываются текущие ограничения: модель должна явно запускать слова, чтобы активировать механизм визуальных примитивов, точность координат в чрезвычайно детализированных сценах ограничена, и еще есть возможности для улучшения возможностей межсценового обобщения.