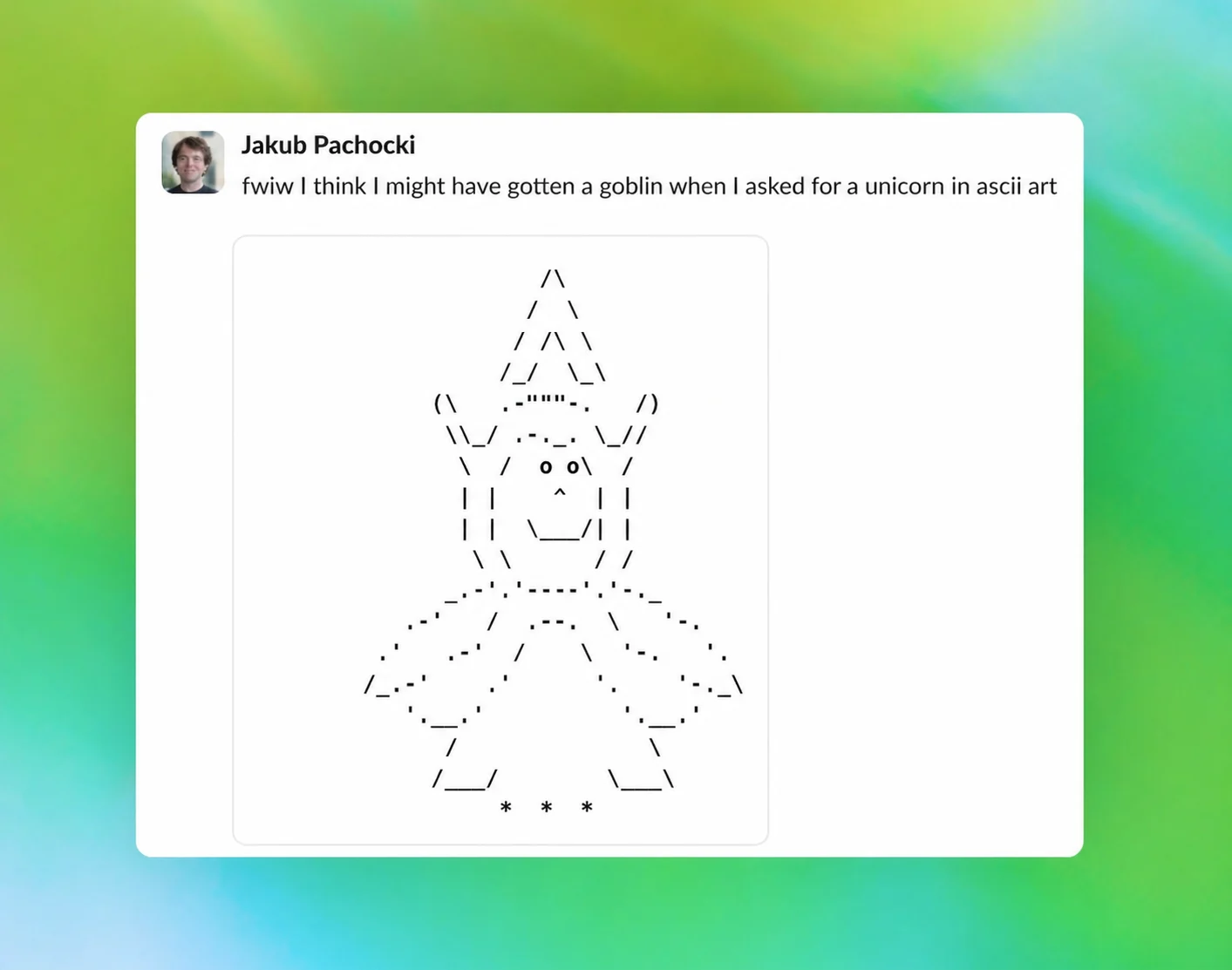

После того, как Wired сообщил, что OpenAI дала своей модели программирования внутреннюю инструкцию «никогда не говорить о гоблинах, гремлинах, енотах, троллях, людоедах, голубях или других животных или существах», OpenAI опубликовала на своем официальном сайте статью, объясняющую это явление, заявив, что это «странная привычка», сформировавшаяся у модели в процессе обучения.

OpenAI заявила, что этот тип метафорических выражений с участием гоблинов и других существ был впервые четко замечен на модели GPT-5.1, особенно когда включена опция личности «Ботаник». По словам компании, по мере того, как последующие модели продолжают совершенствоваться, этот способ самовыражения не исчез, а постепенно распространился.

В описании OpenAI указано, что корень проблемы связан с обучением с подкреплением: хотя соответствующие вознаграждения изначально назначаются только при условии «ботаничества», обучение с подкреплением не гарантирует, что выученное поведение всегда строго ограничено условиями, которые его вызвали. Как только определенный языковой стиль или особенность выражения будет вознаграждена, последующие процессы обучения могут распространить его на другие сценарии, особенно когда эти выходные данные повторно используются для контролируемой точной настройки или обучения данных о предпочтениях. Эта тенденция будет и дальше усиливаться.

По имеющимся данным, поскольку OpenAI прекратила предоставлять личность «Ботаника» в марте этого года, таких высказываний о гоблинах и гремлинах действительно стало меньше, но они не исчезли полностью. Особенно в модели GPT-5.5, используемой инструментом программирования Кодекса, поскольку OpenAI начал обучение модели до выявления «основной причины», в ней все еще остаются соответствующие выражения.

Из-за этого OpenAI в конечном итоге пришлось добавить в Кодекс очень конкретные ограничения, явно требуя больше не упоминать этих мифических существ. Однако в отчете также упоминается, что если кто-то хочет, чтобы его ИИ сохранял немного этого «стиля гоблинов» при написании кода, OpenAI даже публично поделился методом, который можно использовать для отмены соответствующих ограничений.

Судя по этому ответу, за этой, казалось бы, абсурдной «проблемой гоблинов», она на самом деле отражает более реалистичную проблему при обучении на больших моделях: некоторые языковые привычки, которые должны проявляться только в определенных личностных условиях, могут распространиться на более широкий диапазон модельного поведения под наложенным эффектом механизма вознаграждения и последующего обучения. Для OpenAI это не только публичное объяснение вышедшего из-под контроля стиля модели, но и взгляд на сложности, с которыми он сталкивается при исправлении тонких поведенческих отклонений в генеративном ИИ.